本地化部署通义万相 Wan2.1视频生成模型,自媒体又一利器,保姆级教程

今天我相信你也想迫不及待的体验一下本地化部署通义万相 Wan2.1视频生成模型,并且体验一下自己私有化文生视频的效果,让他能快快的应用到自己的场景中,这样以后我们生成视频就再也用去找收费的平台了,全都可以自己解决了。通过以上步骤,你可以成功地在Windows环境下部署通义万相Wan2.1模型并进行视频生成任务。如果有任何问题,请随时告诉我,我会尽力帮助你解决。我们先了解下目前文生视频的其他平台,我

本地化部署通义万相 Wan2.1视频生成模型,自媒体又一利器,保姆级教程

大家好,我 是AI 盒子哥,我会持续将最新大模型的资讯,大模型的实践与大家分享,请持续关注!

昨天我们讲通义万相Wan2.1模型的性能特点、技术架构、使用教程以及对用户的启发意义等

今天我相信你也想迫不及待的体验一下本地化部署通义万相 Wan2.1视频生成模型,并且体验一下自己私有化文生视频的效果,让他能快快的应用到自己的场景中,这样以后我们生成视频就再也用去找收费的平台了,全都可以自己解决了

我们先了解下目前文生视频的其他平台,我都帮你体验过了,目前通义万相Wan2.1模型是全网唯一一个开源的文生视频的大模型。

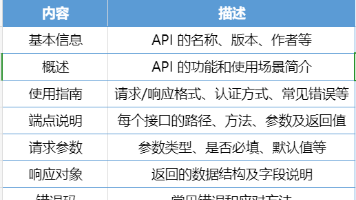

以下是目前国内外一些主要的文生视频平台及其对比信息:

| 平台名称 | 特点 | 适用场景 | 用户评价 |

|---|---|---|---|

| RecCloud | 免费高质量AI视频生成工具,支持多种风格和3D效果 | 创意视频、广告片 | 操作简单,效果逼真 |

| 快手可灵 | 支持生成长达2分钟、1080p分辨率的高清视频,结合3D技术 | 短视频创作 | 高清输出,动态表现佳 |

| Vidu | 长时长、高一致性、高动态性AI视频生成大模型,支持16秒、1080P视频 | 短剧、广告片、创意视频 | 技术领先,视频质量高 |

| 即梦AI | 支持文生视频和图片生成,多种功能如AI绘画、故事创作 | 影视创作、广告制作、社交媒体 | 功能全面,操作简单 |

| 白日梦AI | 支持生成长达6分钟的视频,保持人物和场景一致性 | 长视频创作 | 适合长视频需求 |

| 智谱清影 | 输入文本或图片,30秒内生成6秒视频 | 快速短视频生成 | 生成速度快,适合轻量级创作 |

| Sora | OpenAI开发,生成长达1分钟以上的高保真视频,支持多种生成方式 | 多种场景 | 文本理解出色,生成效果好 |

| Runway | 老牌AI视频生成工具,提供实时涂抹修改功能,但需付费 | 专业视频创作 | 功能强大,但收费 |

| Luma | 将图片转化为高质量视频,视觉表现力强 | 专业摄影、设计 | 视频效果流畅,但需熟悉操作 |

| Pika | 擅长动画制作,支持视频编辑 | 动画创作 | 动画效果佳 |

进入主题Wan2.1模型本地私有化部署,造富之路开启

一、环境准备

1. 硬件环境

- GPU:确保你的电脑有一块支持CUDA 12的NVIDIA GPU,例如RTX 4090、RTX 4070 Ti等。

- 检查GPU是否支持CUDA 12:

- 右键点击“此电脑”,选择“管理”,进入“设备管理器”。

- 展开“显示适配器”,查看你的显卡型号。

- 访问NVIDIA官网,确认你的显卡是否支持CUDA 12。

- 检查GPU是否支持CUDA 12:

- 内存:确保你的电脑至少有32GB RAM。

- 存储:确保你的电脑至少有100GB可用磁盘空间。

2. 软件环境

- 操作系统:确保你的操作系统是Windows 10或更高版本。

- Python:确保你的系统中安装了Python 3.10或更高版本。

- 安装Python 3.10:

- 打开浏览器,访问Python官网。

- 下载Python 3.10的Windows安装程序。

- 运行安装程序,确保勾选“Add Python to PATH”选项。

- 安装Python 3.10:

- CUDA:确保你的系统中安装了CUDA 12.8。

- 安装CUDA 12.8:

- 访问NVIDIA CUDA Toolkit下载页面。

- 下载CUDA 12.8的Windows安装程序。

- 运行安装程序,按照提示完成安装。

- 安装CUDA 12.8:

- CUDNN:确保你的系统中安装了CUDNN 8.9.4。

- 安装CUDNN 8.9.4:

- 登录NVIDIA开发者网站,下载CUDNN 8.9.4 for CUDA 12.8。

- 解压下载的文件,将

bin、include和lib文件夹中的内容复制到CUDA的安装目录下。

- 安装CUDNN 8.9.4:

二、克隆代码仓库

- 安装Git:

- 打开浏览器,访问Git官网。

- 下载Git的Windows安装程序。

- 运行安装程序,按照提示完成安装。

- 克隆通义万相Wan2.1的代码仓库:

- 打开命令提示符(cmd),输入以下命令:

git clone https://github.com/Wan-Video/Wan2.1.git cd Wan2.1

- 打开命令提示符(cmd),输入以下命令:

三、安装依赖

- 创建并激活虚拟环境:

- 打开命令提示符(cmd),输入以下命令:

python -m venv venv venv\Scripts\activate - 你会看到命令提示符前面出现

(venv),表示虚拟环境已激活。

- 打开命令提示符(cmd),输入以下命令:

- 安装Python依赖:

- 打开命令提示符(cmd),输入以下命令:

pip install -r requirements.txt - 等待安装完成。

- 打开命令提示符(cmd),输入以下命令:

- 安装

flash-attention:- 打开命令提示符(cmd),输入以下命令:

pip install flash-attn==2.7.4.post1

- 打开命令提示符(cmd),输入以下命令:

- 替换PyTorch为CUDA版本:

- 打开命令提示符(cmd),输入以下命令:

pip uninstall torch torchvision pip install torch torchvision --index-url https://download.pytorch.org/whl/cu126

- 打开命令提示符(cmd),输入以下命令:

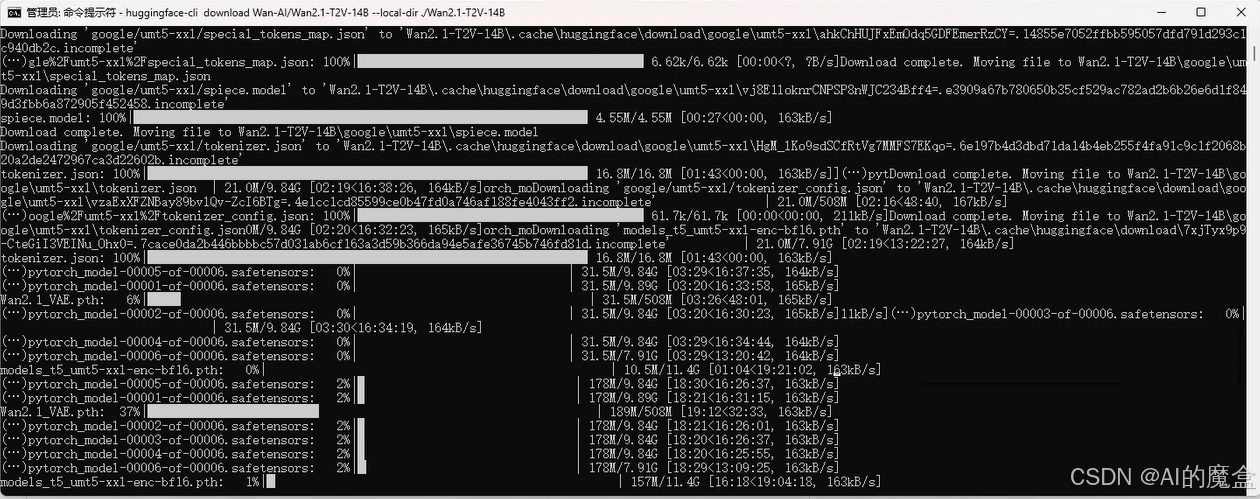

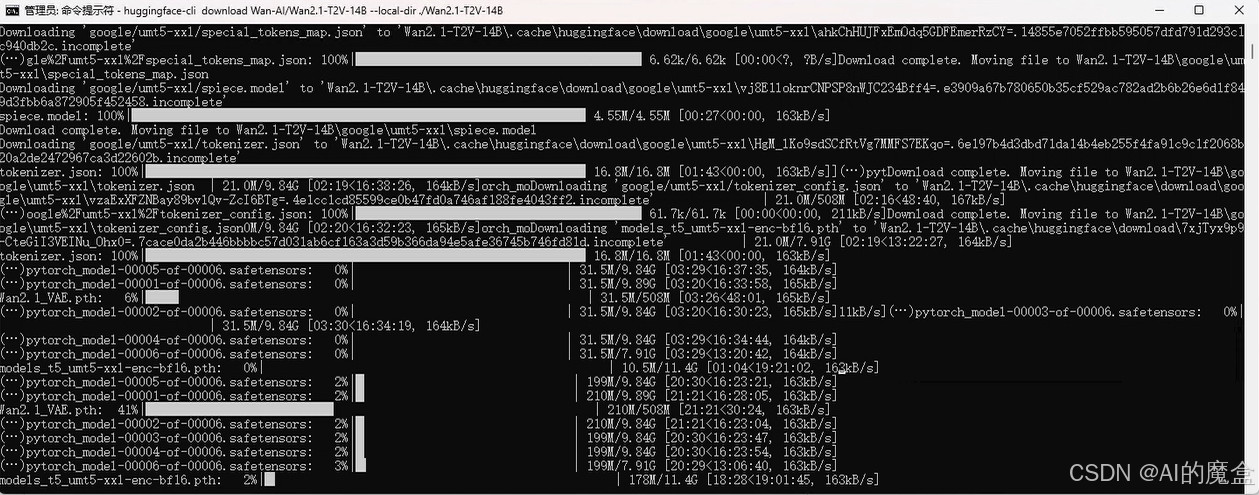

四、下载模型

- 安装Hugging Face CLI:

- 打开命令提示符(cmd),输入以下命令:

pip install "huggingface_hub[cli]"

- 打开命令提示符(cmd),输入以下命令:

- 下载模型:

- 打开命令提示符(cmd),输入以下命令(以T2V-14B为例):

huggingface-cli download Wan-AI/Wan2.1-T2V-14B --local-dir ./Wan2.1-T2V-14B - 如果你下载的是1.3B模型,命令如下:

huggingface-cli download Wan-AI/Wan2.1-T2V-1.3B --local-dir ./Wan2.1-T2V-1.3B

- 打开命令提示符(cmd),输入以下命令(以T2V-14B为例):

五、配置环境变量

- 申请Dashscope API密钥(如果需要使用Dashscope API进行提示扩展):

- 登录Dashscope官网,申请API密钥。

- 设置环境变量:

- 打开命令提示符(cmd),输入以下命令:

set DASH_API_KEY=your_key set DASH_API_URL=https://dashscope-intl.aliyuncs.com/api/v1

- 打开命令提示符(cmd),输入以下命令:

六、运行模型

-

运行文本到视频生成任务:

- 打开命令提示符(cmd),输入以下命令(以T2V-14B为例):

python generate.py --task t2v-14B --size 1280*720 --ckpt_dir ./Wan2.1-T2V-14B --prompt "Your prompt here" --use_prompt_extend --prompt_extend_method 'dashscope' --prompt_extend_target_lang 'ch' - 如果你使用的是1.3B模型,命令如下:

python generate.py --task t2v-1.3B --size 1280*720 --ckpt_dir ./Wan2.1-T2V-1.3B --prompt "Your prompt here" --use_prompt_extend --prompt_extend_method 'dashscope' --prompt_extend_target_lang 'ch'

- 打开命令提示符(cmd),输入以下命令(以T2V-14B为例):

-

运行Gradio界面(可选):

- 进入Gradio目录:

cd gradio - 运行Gradio界面(以T2V-14B为例):

python t2v_14B_singleGPU.py --prompt_extend_method 'dashscope' --ckpt_dir ../Wan2.1-T2V-14B - 如果你使用的是1.3B模型,命令如下:

python t2v_1.3B_singleGPU.py --prompt_extend_method 'dashscope' --ckpt_dir ../Wan2.1-T2V-1.3B

- 进入Gradio目录:

七、注意事项

- CUDA和CUDNN版本:确保CUDA和CUDNN版本与模型要求一致,避免兼容性问题。

- 显存要求:14B模型需要至少24GB显存,1.3B模型需要至少12GB显存。

- 提示扩展:使用Dashscope API或本地模型进行提示扩展可以提高生成视频的质量。

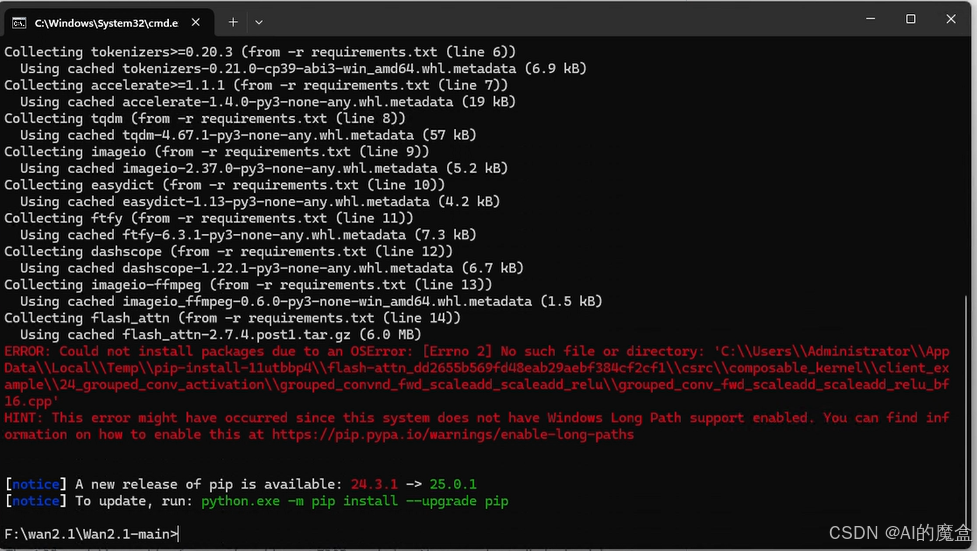

八、过程中遇到的问题

- 执行命令 pip install -r requirements.txt 报错:

报错信息:

ERROR: Could not install packages due to an OSError: [Errno 2] No such file or director

解决方法

解决python安装包“ERROR: Could not install packages due to an OSError”错误

运行如下命令

> pip freeze > requirements.txt

-

安装过程比较慢:

安装比较慢需要开启梯子, -

安装过程报错:

报错信息:

During handling of the above exception, another exception occurred:

Traceback (most recent call last):

File "F:\DP\pyenv-win-master\pyenv-win\versions\3.12.8\Lib\site-packages\huggingface_hub\file_download.py", line 1376, in _get_metadata_or_catch_error

metadata = get_hf_file_metadata(

^^^^^^^^^^^^^^^^^^^^^

File "F:\DP\pyenv-win-master\pyenv-win\versions\3.12.8\Lib\site-packages\huggingface_hub\utils\_validators.py", line 114, in _inner_fn

return fn(*args, **kwargs)

^^^^^^^^^^^^^^^^^^^

File "F:\DP\pyenv-win-master\pyenv-win\versions\3.12.8\Lib\site-packages\huggingface_hub\file_download.py", line 1296, in get_hf_file_metadata

r = _request_wrapper(

^^^^^^^^^^^^^^^^^

File "F:\DP\pyenv-win-master\pyenv-win\versions\3.12.8\Lib\site-packages\huggingface_hub\file_download.py", line 280, in _request_wrapper

response = _request_wrapper(

^^^^^^^^^^^^^^^^^

File "F:\DP\pyenv-win-master\pyenv-win\versions\3.12.8\Lib\site-packages\huggingface_hub\file_download.py", line 303, in _request_wrapper

response = get_session().request(method=method, url=url, **params)

^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^

File "F:\DP\pyenv-win-master\pyenv-win\versions\3.12.8\Lib\site-packages\requests\sessions.py", line 589, in request

resp = self.send(prep, **send_kwargs)

^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^

File "F:\DP\pyenv-win-master\pyenv-win\versions\3.12.8\Lib\site-packages\requests\sessions.py", line 703, in send

r = adapter.send(request, **kwargs)

^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^

File "F:\DP\pyenv-win-master\pyenv-win\versions\3.12.8\Lib\site-packages\huggingface_hub\utils\_http.py", line 96, in send

return super().send(request, *args, **kwargs)

^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^

File "F:\DP\pyenv-win-master\pyenv-win\versions\3.12.8\Lib\site-packages\requests\adapters.py", line 713, in send

raise ReadTimeout(e, request=request)

requests.exceptions.ReadTimeout: (ReadTimeoutError("HTTPSConnectionPool(host='huggingface.co', port=443): Read timed out. (read timeout=10)"), '(Request ID: f9c27085-bf9a-4dc2-a4bb-c3f86c4a6d26)')

解决方法:

搭建梯子,然后再重新执行命令

huggingface-cli download Wan-AI/Wan2.1-T2V-14B --local-dir ./Wan2.1-T2V-14B

通过以上步骤,你可以成功地在Windows环境下部署通义万相Wan2.1模型并进行视频生成任务。如果有任何问题,请随时告诉我,我会尽力帮助你解决。

感谢您的的关注,我会将最好的实践与您分享!

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)