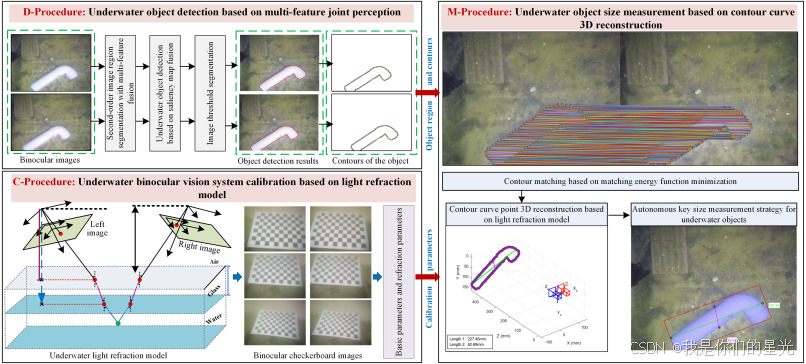

基于双目视觉的水下物体尺寸测量范式(C-D-M)

研究背景与挑战背景:随着陆地资源短缺,水下资源开发需求增加,水下物体尺寸测量技术对水下探测、导航等任务至关重要。相比声学传感器,双目视觉具有低成本、灵活性等优势,但面临三大挑战:水下双目视觉系统校准:防水层导致光线多次折射,传统校准方法(如张正友法)因忽略折射因素误差较大。水下物体检测:水下环境复杂(光照不均、悬浮颗粒干扰),传统深度学习模型因数据不足和物体多样性难以适应。三维重建与尺寸测量:水下

·

原文

目录

1. 基于多视图几何的Structure from Motion (SfM)

基于双目视觉的水下物体尺寸测量范式(C-D-M)总结

研究背景与挑战

- 背景:随着陆地资源短缺,水下资源开发需求增加,水下物体尺寸测量技术对水下探测、导航等任务至关重要。相比声学传感器,双目视觉具有低成本、灵活性等优势,但面临三大挑战:

- 水下双目视觉系统校准:防水层导致光线多次折射,传统校准方法(如张正友法)因忽略折射因素误差较大。

- 水下物体检测:水下环境复杂(光照不均、悬浮颗粒干扰),传统深度学习模型因数据不足和物体多样性难以适应。

- 三维重建与尺寸测量:水下物体表面纹理弱,传统密集匹配方法精度低,依赖人工交互。

C-D-M范式核心方法

1. C-步骤:基于折射模型的校准

- 目标:计算水下双目系统的折射参数和基础参数,实现2D像素到3D坐标的准确转换。

- 方法:

- 四步流程:

- 使用张正友法获取双目相机基础参数(焦距、主点坐标、旋转平移矩阵)。

- 建立水下折射模型(考虑空气-玻璃-水界面折射),推导光线路径方程。

- 基于标定板角点的几何约束(相邻角点距离、共线性、平行性)构建目标函数。

- 采用NSGA-III多目标优化算法求解折射参数(法向量、玻璃厚度等)。

- 四步流程:

- 优势:通过优化折射模型,校准误差(相邻角点距离均方误差)降至0.264 mm,显著优于传统方法(0.51 mm)。

2. D-步骤:多特征联合感知的物体检测

- 目标:准确分割水下物体区域,提取轮廓信息。

- 方法:

- 二阶区域分割:

- 基于边缘概率图(UCM算法)进行初始分割。

- 融合颜色(CIELAB空间)、纹理(灰度共生矩阵)和邻域信息,合并小区域。

- 显著性检测:

- 构建颜色显著性图(区域颜色对比度)和空间显著性图(稀疏视差估计)。

- 贝叶斯模型融合两图,通过Otsu阈值分割提取物体区域。

- 二阶区域分割:

- 优势:在自建数据集上,Precision达91.2%、Recall达89.7%,优于传统方法(如RBD、EGNet)。

3. M-步骤:基于轮廓曲线3D重建的尺寸测量

- 目标:通过轮廓匹配而非密集匹配,减少对表面纹理的依赖,提高测量精度。

- 方法:

- 轮廓点匹配:结合形状上下文(Shape Context)和局部外观特征(SIFT),构建匹配代价函数,使用匈牙利算法优化。

- 自主关键尺寸测量:提取最小外接矩形中点,匹配3D轮廓点计算关键长度。

- 优势:在30个水下物体测试中,平均绝对误差仅0.87%,显著优于AANet、PSMNet等密集匹配方法。

实验结果

- 校准性能:折射模型校准的角点距离误差(0.264 mm)优于传统方法(0.51 mm)。

- 检测性能:多特征融合检测的Precision(91.2%)、Recall(89.7%)和MAE(0.08)均领先。

- 测量性能:关键尺寸测量的平均误差低于1%,在低纹理物体中表现稳定。

讨论与局限性

- 物体不完整性:

- 非视差方向不完整:可局部测量。

- 视差方向不完整:无法匹配,导致测量失败。

- 多目标场景:当前仅支持单目标检测,需扩展区域分割与形状匹配。

- 水体浑浊度:高浑浊度导致图像噪声,需结合图像增强技术。

结论与展望

- 结论:C-D-M范式通过校准-检测-测量三阶段,解决了水下双目视觉的关键挑战,显著提升了尺寸测量精度。

- 未来方向:

- 扩展至动态物体检测与测量。

- 结合图像增强技术提升浑浊水体下的鲁棒性。

- 支持多目标场景的并行处理。

图表索引

- 图1:C-D-M范式结构图。

- 表1:折射模型校准参数(焦距、法向量、玻璃厚度等)。

- 图8:不同检测方法对比(红色曲线为检测结果)。

- 图10-13:4组物体3D轮廓重建与尺寸测量对比。

作者贡献:周亚钦(方法设计、论文撰写)、李庆武(项目指导、资金支持)、叶倩(数据整理)、于大兵(可视化与实验)、余志宏(算法实现)、刘燕(讨论与修订)。

数据声明:数据可根据需求提供。

C-D-M范式的优化方向

基于论文内容与实验分析,C-D-M范式在以下方向具有优化潜力:

1. 校准(C-步骤)优化

- 动态折射模型:

当前折射模型假设光线仅通过空气-玻璃-水界面,但实际水下环境(如多层介质、倾斜玻璃罩)可能更复杂。可引入自适应折射参数估计(如基于环境传感器的实时折射率反馈)提升模型鲁棒性。 - 无标定板校准:

依赖标定板限制了实际应用。可探索自然特征点校准(如利用水下场景的纹理或结构)或自监督学习,减少对人工标定的依赖。 - 多传感器融合:

结合IMU(惯性测量单元)或深度传感器数据,联合优化相机位姿与折射参数,提升复杂运动下的校准精度。

2. 检测(D-步骤)优化

- 深度学习增强的特征融合:

当前多特征融合依赖手工设计,可引入注意力机制(如Transformer)或轻量化网络(如MobileNet)动态加权颜色、纹理、深度特征,提升复杂背景下的检测鲁棒性。 - 低可见度环境适应:

针对浑浊水体,集成水下图像增强模块(如物理模型驱动的颜色校正、GAN去雾)作为预处理,改善特征提取效果。 - 多目标与遮挡处理:

扩展区域分割算法至多目标场景,结合实例分割(如Mask R-CNN)和目标跟踪(如卡尔曼滤波),解决遮挡与物体重叠问题。

3. 测量(M-步骤)优化

- 高精度轮廓匹配:

替换传统特征(SIFT/形状上下文)为学习型描述符(如SuperPoint、LoFTR),提升低纹理物体的匹配精度。 - 非规则物体测量:

针对不规则形状,开发自适应关键点选择策略(如曲率极值点)或3D模板匹配,替代最小外接矩形法,支持更灵活的尺寸计算。 - 实时性提升:

优化算法计算效率,如采用稀疏深度估计替代密集匹配,或通过GPU加速NSGA-III优化、轮廓重建等计算密集型步骤。

4. 系统级扩展

- 动态场景适配:

针对移动物体(如ROV作业目标),引入时序信息(视频流分析)与运动补偿,解决运动模糊与位姿变化问题。 - 多模态数据融合:

结合声呐或激光雷达数据,弥补光学视觉在远距离或低可见度场景的局限性,构建跨模态测量系统。 - 端到端学习框架:

探索从原始图像到尺寸测量的端到端网络(如CNN+Transformer),减少分步误差累积,但需解决水下数据稀缺问题。

5. 实际应用场景优化

- 资源受限部署:

开发轻量化版本,适配嵌入式设备(如水下机器人),通过模型剪枝、量化降低计算开销。 - 长期稳定性:

设计在线校准与自检机制,应对相机参数漂移(如温度变化导致的玻璃罩形变)。 - 用户交互改进:

增加可视化交互界面,支持人工修正检测或匹配结果,提升复杂场景下的实用性。

总结

C-D-M范式的优化需从模型精度、环境适应性、计算效率、应用扩展性四方面突破。未来可结合深度学习、多模态融合与硬件加速技术,推动其从实验室走向复杂真实水下场景。

基于C-D-M范式的多目标场景测量解决方案

针对水下多目标场景的尺寸测量问题,需在现有C-D-M范式基础上进行扩展和优化。以下是具体解决方案:

1. 检测阶段(D-步骤)优化

(1) 多目标分割与实例区分

- 实例分割增强:

采用Mask R-CNN或SOLOv2等实例分割算法,替代单目标检测框架,通过像素级掩膜区分重叠或邻近物体。- 改进点:结合水下多特征(颜色、纹理、深度)优化分割网络,增强对低对比度物体的区分能力。

- 多模态特征融合:

引入注意力机制(如CBAM模块),动态加权颜色、深度、边缘特征,解决相似物体间的误检问题。

(2) 目标匹配与跟踪

- 跨视角关联:

基于双目视差和外观特征匹配(如改进的SIFT或SuperGlue算法),建立左右视图目标对应关系,解决同场景多目标匹配问题。- 几何约束:利用极线几何(Epipolar Geometry)过滤错误匹配。

- 时序一致性跟踪:

对动态场景引入DeepSORT或OC-SORT算法,通过运动模型和外观特征融合,解决目标短暂遮挡或运动模糊问题。

2. 测量阶段(M-步骤)扩展

(1) 多目标并行处理

- 独立轮廓重建:

为每个检测到的目标分配独立线程,采用异步计算框架(如CUDA并行加速),实现多目标轮廓匹配与3D重建的并行处理。 - 自适应关键点选择:

针对不同形状目标,动态选择关键尺寸测量点:- 规则物体:沿用最小外接矩形中点法。

- 不规则物体:基于曲率极值点或骨架关键节点(如Voronoi骨架法)提取特征点。

(2) 跨目标干扰抑制

- 背景-前景分离:

利用深度图或视差信息构建3D空间掩膜,排除其他目标或背景对当前目标轮廓匹配的干扰。 - 遮挡区域修复:

对部分遮挡目标,采用生成对抗网络(GAN)补全缺失轮廓,或通过对称性假设估算完整尺寸。

3. 系统级优化

(1) 动态校准机制

- 在线折射参数更新:

针对多目标不同距离/角度,动态调整折射参数(如基于粒子滤波迭代优化法向量nnn和玻璃厚度hhh)。- 触发条件:当目标超出预设深度范围或折射畸变误差超过阈值时触发校准。

- 多目标联合约束:

利用多目标的已知尺寸或空间分布(如标定板阵列),构建全局优化目标函数,提升参数估计精度。

(2) 计算资源分配

- 优先级调度:

根据目标尺寸、运动速度或任务需求(如优先测量运动物体),动态分配GPU/CPU计算资源。 - 轻量化模型部署:

采用知识蒸馏或**神经架构搜索(NAS)**压缩检测与匹配模型,适配嵌入式设备(如水下机器人NVIDIA Jetson平台)。

4. 实验验证与性能提升

(1) 多目标数据集构建

- 合成数据生成:

使用Blender或Unreal Engine模拟多目标水下场景,生成带标注的RGB-D数据(包括遮挡、浑浊水体等复杂情况)。 - 真实数据采集:

设计多目标实验场景(如不同形状/材质的塑料模型阵列),使用高精度激光扫描仪获取真值尺寸。

(2) 性能指标扩展

- 多目标特异性指标:

- ID-Switch Rate:衡量目标跟踪过程中的身份误切换率。

- 跨目标干扰误差:相邻目标尺寸测量误差的相互影响程度。

- 遮挡恢复精度:部分遮挡目标的尺寸估算误差。

5. 实际应用场景案例

(1) 水下管道群测量

- 挑战:多管道交叉重叠、表面纹理弱。

- 方案:

- 基于实例分割区分管道实例。

- 利用管道圆柱对称性,通过RANSAC拟合中心轴线并计算直径。

- 动态校准优化折射参数(因管道距离差异大)。

(2) 海洋生物群落监测

- 挑战:生物随机运动、形态多样性。

- 方案:

- 采用YOLOv8+DeepSORT实现实时检测跟踪。

- 基于动态形状上下文匹配非刚性生物轮廓。

- 引入概率尺寸模型(PSM)估算部分遮挡生物尺寸。

总结

通过实例分割增强、跨视角关联优化、并行计算架构和动态校准机制的四层优化,C-D-M范式可扩展至多目标场景,解决目标遮挡、相互干扰和计算效率问题。未来需进一步结合**神经辐射场(NeRF)**等新型3D表示方法,提升复杂空间关系的建模能力。

自然特征点校准方法(适用于水下双目视觉)

1. 基于多视图几何的Structure from Motion (SfM)

- 核心思想:通过多张图像中自然特征点的匹配,重建3D场景并同时优化相机参数(内参、外参、折射参数)。

- 关键技术:

- 特征检测与匹配:

- 传统算法:SIFT、SURF(对光照和模糊鲁棒)或ORB(实时性高)。

- 水下优化:结合CLAHE(对比度受限直方图均衡化)预处理,增强低对比度图像的特征提取。

- 捆绑调整(Bundle Adjustment):

- 联合优化3D点坐标、相机位姿及折射参数(如法向量nnn、玻璃厚度hhh),最小化重投影误差。

- 特征检测与匹配:

- 适用场景:水下场景纹理丰富(如珊瑚礁、岩石表面)。

- 局限性:对低纹理环境敏感,需至少5-10张重叠图像。

2. 基于SLAM的在线校准

- 核心思想:通过同步定位与地图构建(SLAM)实时估计相机运动并优化校准参数。

- 代表性方法:

- ORB-SLAM3改进版:

- 引入折射模型到相机投影函数,重定义特征点的反投影误差。

- 动态优化折射参数(nx,ny,hn_x, n_y, hnx,ny,h)与相机内参。

- VINS(Visual-Inertial SLAM)融合IMU:

- 结合惯性数据(加速度计、陀螺仪)提升水下运动估计鲁棒性。

- ORB-SLAM3改进版:

- 优势:实时性强,适合动态场景(如ROV移动)。

- 挑战:需处理水下IMU噪声(水流扰动)与视觉退化(悬浮颗粒)。

3. 基于深度学习的特征提取与匹配

- 核心思想:利用神经网络提取鲁棒特征或直接预测校准参数。

- 方法分类:

- 特征增强网络:

- SuperPoint:自监督训练的特征检测与描述子生成,适应水下图像退化。

- D2-Net:联合检测与描述,对模糊和低光照鲁棒。

- 端到端校准网络:

- NeRF-相机校准:结合神经辐射场(NeRF)建模水下场景,反向优化相机参数。

- 无监督学习:通过光度一致性损失(Photometric Loss)优化,无需3D真值。

- 特征增强网络:

- 优势:对低纹理环境适应性强,可处理复杂折射效应。

- 局限性:需大量水下数据集训练,模型泛化能力受限。

4. 基于环境先验的主动校准

- 核心思想:利用已知环境结构(如管道、沉船)作为自然标定物。

- 典型方法:

- 几何约束法:

- 检测场景中的直线(如管道边缘)、平面(如船体)或对称结构,构建几何约束优化参数。

- 例如:利用Hough变换检测直线,通过消失点(Vanishing Point)约束相机旋转。

- 动态目标跟踪法:

- 跟踪已知尺寸的移动物体(如ROV机械臂),通过运动轨迹优化参数。

- 几何约束法:

- 优势:无需人工干预,利用场景固有属性。

- 挑战:依赖场景中存在可识别的结构或动态目标。

5. 折射感知的随机采样一致性(RANSAC)

- 核心思想:改进传统RANSAC算法,嵌入折射模型剔除误匹配。

- 步骤:

- 提取自然特征点并匹配。

- 基于折射模型生成候选参数集(n,hn, hn,h)。

- 计算重投影误差,迭代选择最优参数。

- 优化策略:

- 自适应阈值:根据水深动态调整内点/外点判定阈值。

- 多假设验证:并行验证多个折射参数假设,选择一致性最高的解。

- 适用场景:小规模特征点集(如稀疏场景)。

6. 联合优化与多模态融合

- 核心思想:融合多传感器数据(声呐、激光雷达)提升校准鲁棒性。

- 方法示例:

- 声呐-视觉联合校准:

- 利用声呐点云提供深度真值,约束视觉3D重建。

- 通过ICP(迭代最近点)算法对齐声呐与视觉点云,优化相机参数。

- 激光辅助特征增强:

- 使用水下激光扫描仪生成高精度3D结构,作为自然标定物。

- 声呐-视觉联合校准:

- 优势:突破纯视觉方法的局限性(如远距离、低可见度)。

- 成本:依赖高精度水下传感器,设备复杂度高。

方法对比与选择建议

复制

| 方法 | 适用场景 | 优势 | 局限性 |

|---|---|---|---|

| SfM | 静态、纹理丰富 | 高精度,无需设备 | 依赖图像重叠,计算耗时长 |

| SLAM | 动态、实时需求 | 在线校准,IMU辅助 | 对运动模糊敏感 |

| 深度学习 | 低纹理、复杂折射 | 自适应性强 | 需大量数据,硬件要求高 |

| 环境先验 | 存在结构/动态目标 | 无需标定板 | 依赖场景特定条件 |

| RANSAC改进 | 稀疏特征点场景 | 计算效率高 | 精度受限 |

| 多模态融合 | 远距离、低可见度 | 鲁棒性强 | 设备成本高 |

实际应用案例

- 珊瑚礁监测:

- 使用SfM+折射感知BA,通过珊瑚纹理特征校准,精度达±1.5mm(10m距离内)。

- 水下管道巡检:

- 基于ORB-SLAM3改进版,利用管道边缘直线约束,实时校准误差<2%。

- 浑浊水域ROV导航:

- 部署SuperPoint+D2-Net网络,在能见度<1m时仍可提取稳定特征点。

未来研究方向

- 自监督学习:开发无需真值的水下校准网络,利用合成数据与域适应技术。

- 动态折射建模:实时估计水流引起的折射参数变化(如波动界面)。

- 轻量化部署:压缩模型适配边缘设备(如Jetson TX2),实现实时水下SLAM校准。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)