【AI辅助设计】电商设计师看看?AI+Blender 打造真实场景渲染图

本文的重点,是介绍由AI生成背景图,然后根据背景生成[HDR],再放到Blender中进行渲染的整个过程。这个工作流的好处是:电商渲染图不需要苦苦地去找场景模型,同时又避免了,纯AI换背景,那种不可控和产品会变化的弱点。。这块基本没有什么技巧,只需要提示语即可。。属于3D软件技巧,网上很多教程哈~

大家好我是AIGC阿道夫

本文的重点,是介绍由AI生成背景图,然后根据背景生成[HDR],再放到Blender中进行渲染的整个过程。这个工作流的好处是:电商渲染图不需要苦苦地去找场景模型,同时又避免了,纯AI换背景,那种不可控和产品会变化的弱点。

这里用到几个AI的技术要点:

-

「Midjourney生成电商背景图」 。这块基本没有什么技巧,只需要提示语即可。

-

「单图生成HDR技术」

-

「Blender渲染合成」 。属于3D软件技巧,网上很多教程哈~

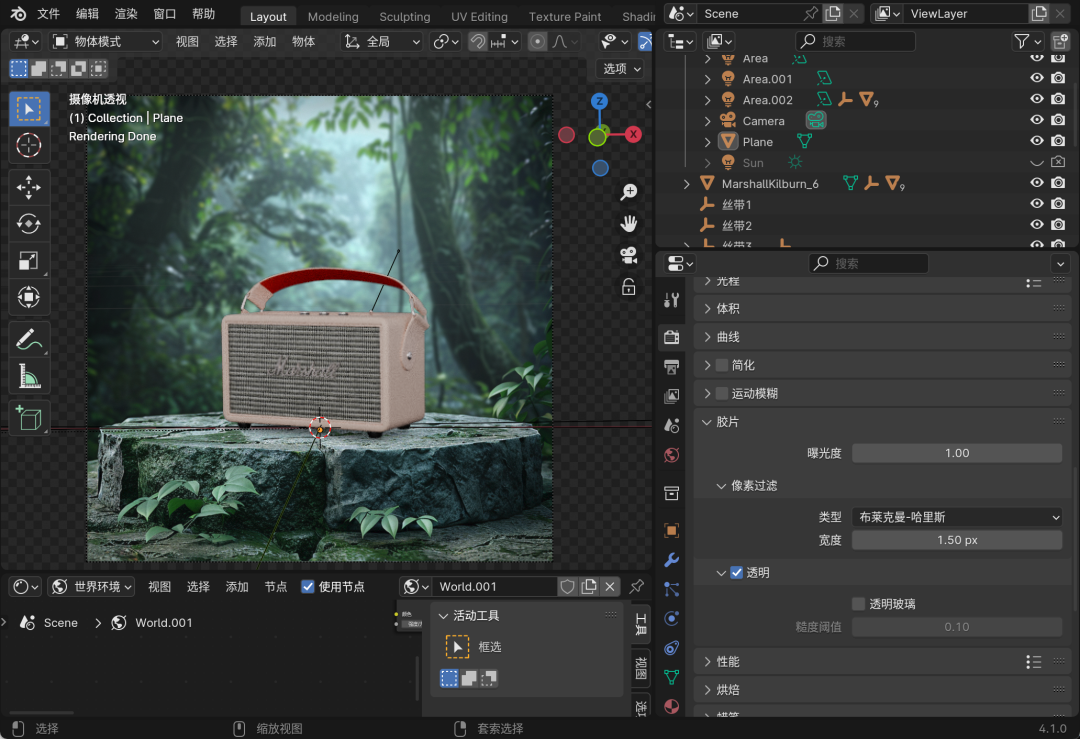

看看效果

先show一下效果,由于本人不是专业的电商设计师,所以,大家看看大致的效果,主要看融合后的感觉,背景是一张静态的图片,效果图稍微调了一下色调。

这份完整版的AI绘画(SD、comfyui、AI视频)整合包已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

hdr1.png

hdr car.png

下面的瓶子有点脏了,发现透明材质不会那么好表现~🥱,毕竟不是实体3D。

hdr3.png

制作过程

正如上面所属,我们需要用到3个工具,分别是Midjourney、DiffusionLight和Blender。

这份完整版的AI绘画(SD、comfyui、AI视频)整合包已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AI生成背景部分

我们希望生成一个山野森林里面的一个石台,使用mj的V6模型,可以真实还原出来。提示语如下:

**stone podium on forest background, green color palette, mockup design, digital art, 3d render, ultra realistic, product photography, high resolution, high detail, high quality, sharp focus, hyperrealistic, no blur, bokeh effect, cinematic mood, dark colors, blurred background, fantasy landscape, blue sky, green trees, foggy weather, dramatic light, contrast, shadow and backlight, octane rendering, ray tracing, epic, cinematic, volumetric lighting, HDR --v 6.0 --style raw**

* 1

* 2

选择U3进行放大,即可得到一张1024x1024的图。

DiffusionLight处理

因为我们为了合成的真实,所以HDR光照需要跟背景图保持一致,我们使用开源的DiffusionLight技术进行生成。关于这个技术我之前有介绍过,这里简单说说安装的过程。

推荐大家使用wsl安装,这样会顺畅很多,也不会影响Windows的环境。至于如何安装wsl2,看微软官方的教程即可。同时要安装nvidia的驱动和cuda

tookit,这些自行搜索互联网或者问GPT即可。我们打开wsl的命令行工具。

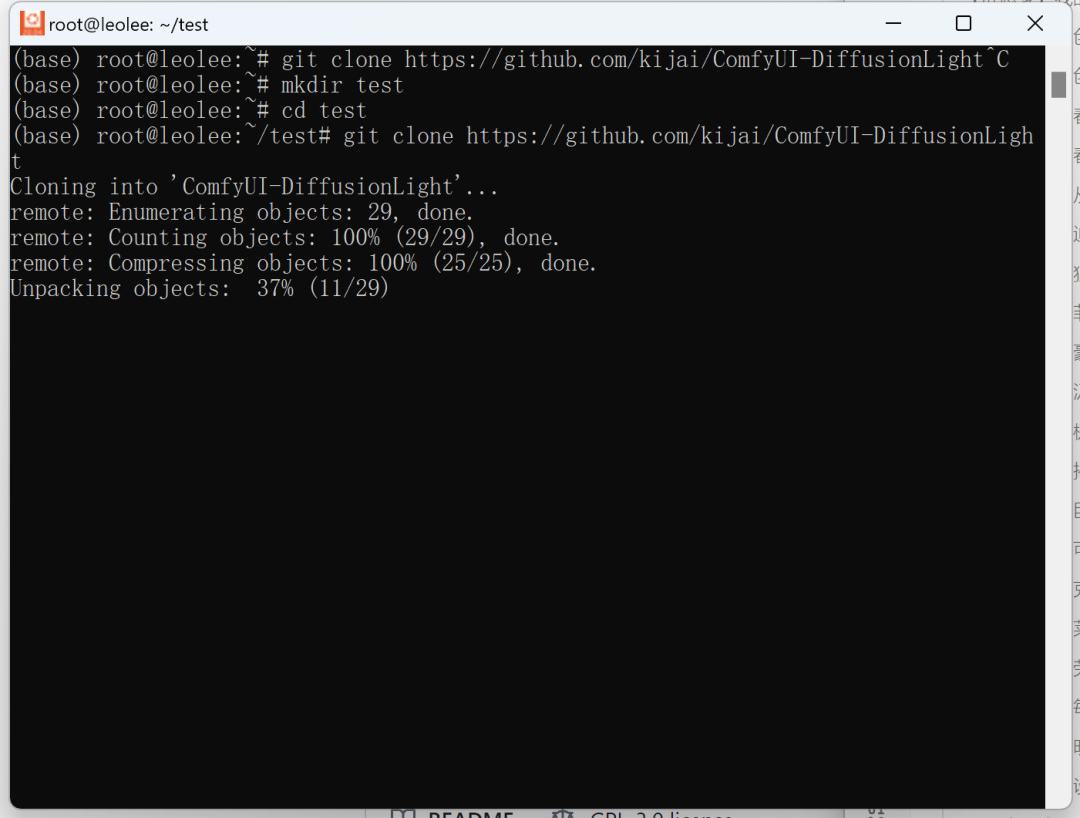

拉取代码

git clone https://github.com/kijai/ComfyUI-DiffusionLight

* 1

* 2

拉取完成后,CD到ComfyUI-DiffusionLight目录。根据官方提供的方法,逐个输入:

conda env create -f environment.yml

conda activate diffusionlight

pip install -r requirements.txt

* 1

* 2

* 3

* 4

这里大家也需要安装conda,我用的是miniconda。安装依赖这里,我遇到个坑,就是OpenEXR安装不上,所以我打开requirements.txt,手动把版本号改为:OpenEXR>=1.3.9,就可以安装了。

运行程序

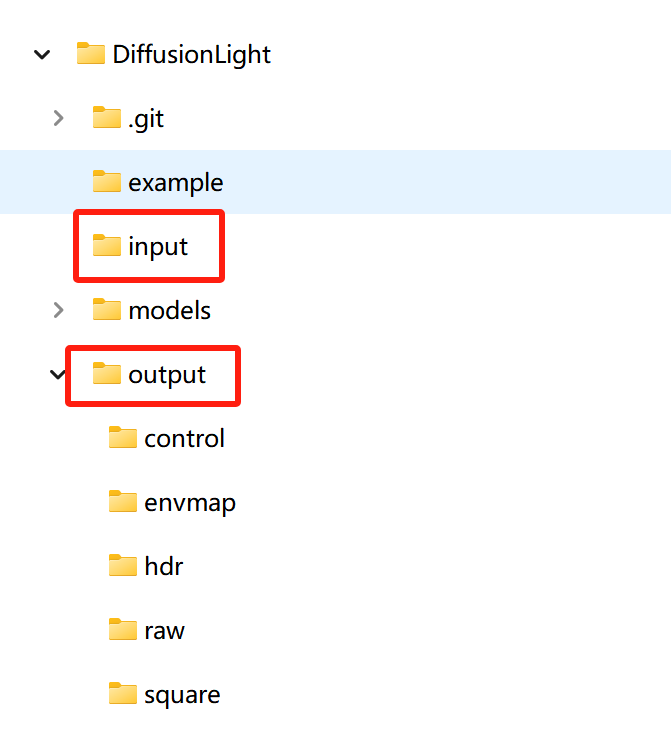

在项目根目录新建一个input和output文件夹。

把ComfyUI生成的图,放进input文件夹中。然后依次运行:

python inpaint.py --dataset input --output_dir output

python ball2envmap.py --ball_dir output/square --envmap_dir output/envmap

python exposure2hdr.py --input_dir output/envmap --output_dir output/hdr

* 1

* 2

* 3

* 4

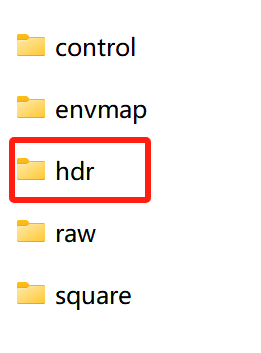

注意,运行第一行代码时间比较长,4090大约运行了10分钟。最终你可以在,output/hdr 文件夹中,找到最终的输出图。

输出效果

会输出一个HDR球和HDR文件。

bg_ev-00.png

看得出来,灯光的大致关系是没问题的,虽然有瑕疵,材质和环境的理解都到位,作为光源合成,问题不大。另外一张大雪天的路HDR,效果稍微好点,不过也好像变成了广场😂,但作为光源问题不大~。

road_ev-00.png

Blender合成

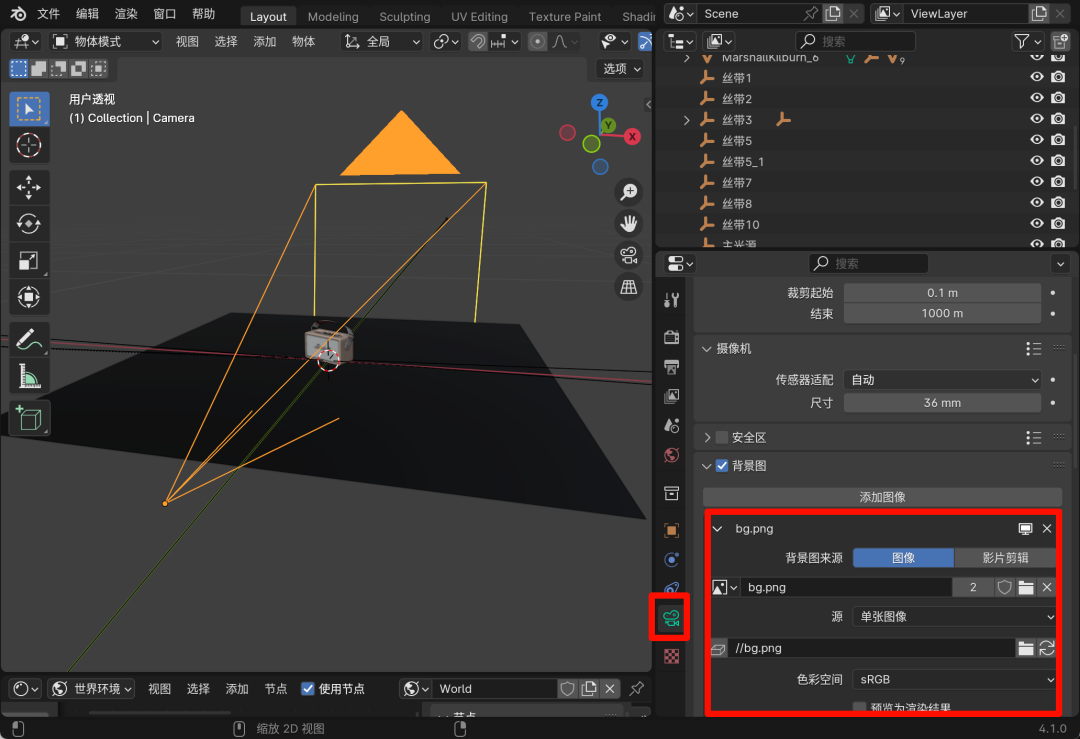

给摄像机添加背景

导入模型后,我们新建一个摄像机,在这里添加mj生成的背景。

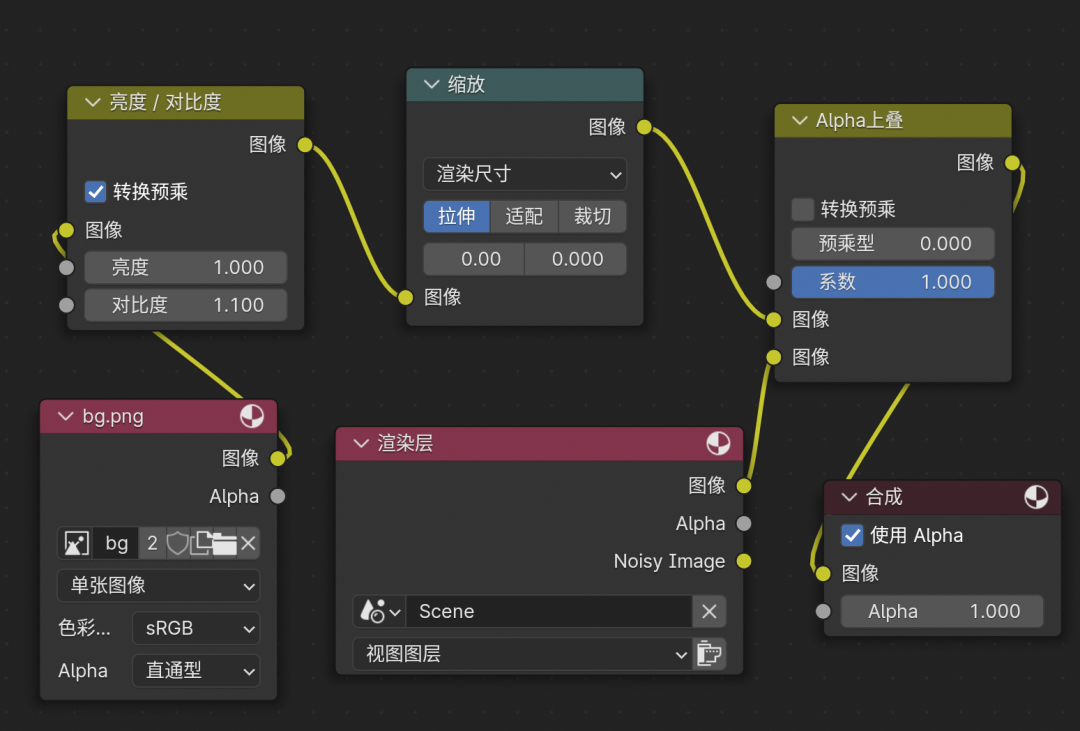

切换到合成模块,按照我的节点,进行链接,这样,渲染的时候才可以把背景图渲染出来。

制作阴影

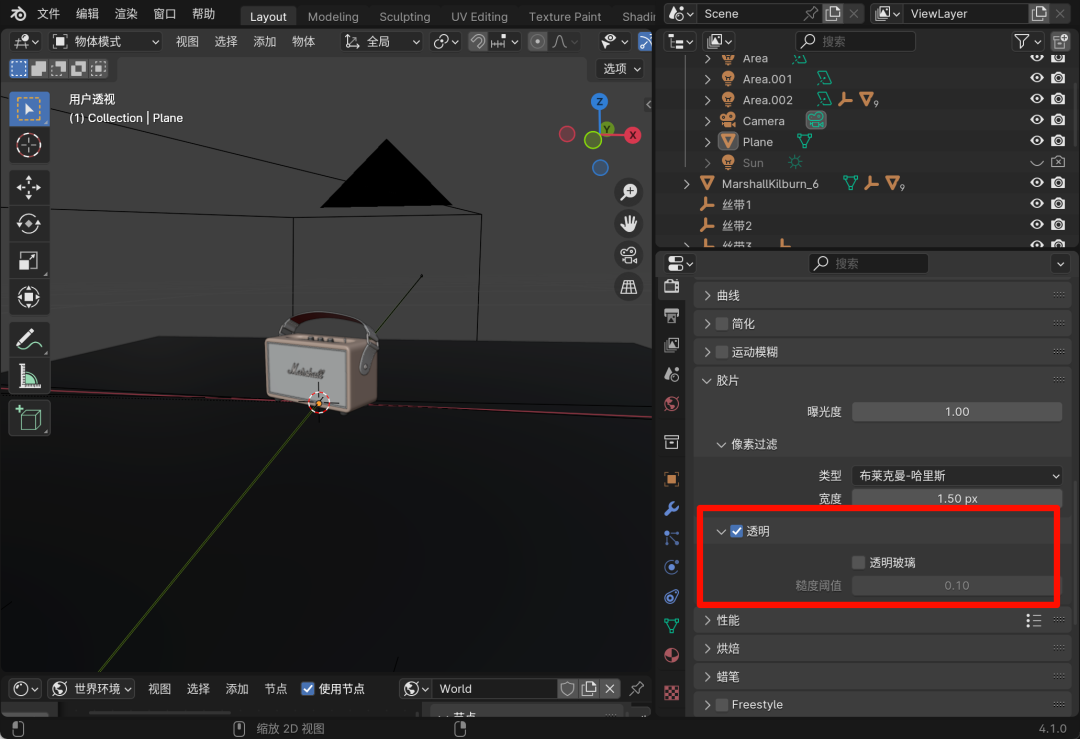

新建一个平面,随便给个材质,然后在模型属性那里,打开阴影捕捉。

在渲染属性那里,勾选透明。

在切换到cycle渲染器,可以预览看看效果。

可以看到产品和背景已经有了初步的融合,但是因为光照不是由背景图产生的,所以显得很假。

HDR设置

进入HDR节点编辑,把DiffusionLight生成的HDR添加进来,调整一下对比度、亮度、亮度,还有角度。

细化反射

事实上,底部的阴影已经不错了,但是在物理世界中,底部需要反射地面的元素,所以这里还有一步,就需要把接收阴影的平面,加上背景图的元素,我这里制作粗糙点,直接往上面贴了个背景图,同时缩放对好位置。

换个场景可能对比明显点。

以下是没加贴图的。

加了贴图后。

方案的缺点

缺点还是有的,毕竟是模拟和逼近的做法,效果肯定比不上扎扎实实建模搭场景的,如果作为一个快速出图的工作流,可以尝试尝试。另外,生成的HDR分辨率不高,如果需要制作线下广告图,或者更高精度的主图,应该不能胜任~🥱。

做个调查

最后做个调查,最近我们尝试将这类似的技术产品化,希望结合传统工具和AI,赋能给设计师们,不知道各位设计师是否有兴趣尝试?

资料软件免费放送

次日同一发放请耐心等待

但由于AIGC刚刚爆火,网上相关内容的文章博客五花八门、良莠不齐。要么杂乱、零散、碎片化,看着看着就衔接不上了,要么内容质量太浅,学不到干货。

这里分享给大家一份Adobe大神整理的《AIGC全家桶学习笔记》,相信大家会对AIGC有着更深入、更系统的理解。

这份完整版的AI绘画(SD、comfyui、AI视频)整合包已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

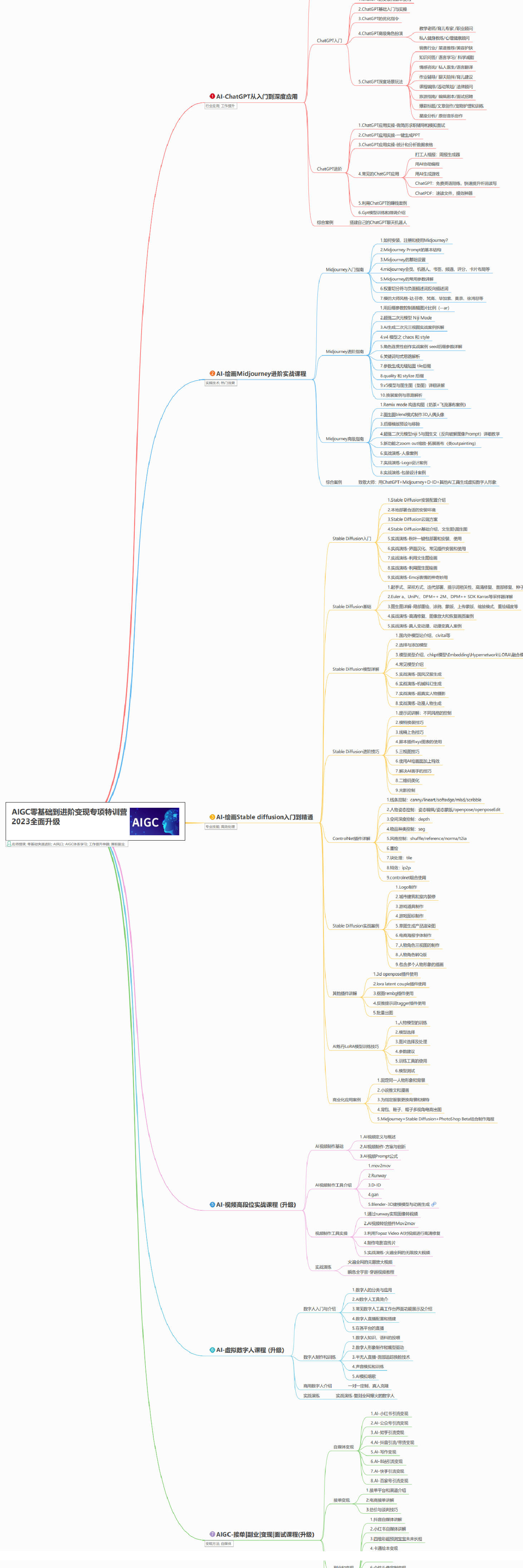

AIGC所有方向的学习路线思维导图

这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。如果下面这个学习路线能帮助大家将AI利用到自身工作上去,那么我的使命也就完成了:

AIGC工具库

AIGC工具库是一个利用人工智能技术来生成应用程序的代码和内容的工具集合,通过使用AIGC工具库,能更加快速,准确的辅助我们学习AIGC

有需要的朋友,可以点击下方卡片免费领取!

精品AIGC学习书籍手册

书籍阅读永不过时,阅读AIGC经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验,结合自身案例融会贯通。

AI绘画视频合集

我们在学习的时候,往往书籍源码难以理解,阅读困难,这时候视频教程教程是就很适合了,生动形象加上案例实战,科学有趣才能更方便的学习下去。

这份完整版的AI绘画(SD、comfyui、AI视频)整合包已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献137条内容

已为社区贡献137条内容

所有评论(0)