基于K近邻算法的分类器的实现

k近邻算法(k-Nearest Neighbors,简称kNN)是一种经典的机器学习算法,广泛应用于分类和回归任务中。它的核心思想是“近朱者赤,近墨者黑”,即一个数据点的类别或值可以通过其周围最近的k个邻居来决定。算法原理kNN算法是一种基于实例的学习方法,它不需要对数据进行复杂的建模和训练,而是直接利用训练数据进行预测。输入:一个待预测的样本点、训练数据集以及一个正整数k。计算:计算待预测样本点

前言

在机器学习领域,有许多经典的算法可以用于分类问题。而K近邻(KNN)算法是其中一种简单而有效的方法。本文将深入探讨KNN算法的原理和实现,并介绍基于KNN算法的分类器的实际应用。

一、对近邻算法的介绍

k近邻算法(k-Nearest Neighbors,简称kNN)是一种经典的机器学习算法,广泛应用于分类和回归任务中。它的核心思想是“近朱者赤,近墨者黑”,即一个数据点的类别或值可以通过其周围最近的k个邻居来决定。

算法原理

kNN算法是一种基于实例的学习方法,它不需要对数据进行复杂的建模和训练,而是直接利用训练数据进行预测。其基本步骤如下:

-

输入:一个待预测的样本点、训练数据集以及一个正整数k。

-

计算:计算待预测样本点与训练数据集中每个样本点之间的距离(常用欧氏距离、曼哈顿距离或明可夫斯基距离等)。

-

排序:根据距离对训练数据集中的样本点进行排序,找出距离最近的k个样本点(即k个邻居)。

-

决策:

-

分类任务:统计这k个邻居中出现次数最多的类别标签,将其作为待预测样本点的预测类别。

-

回归任务:计算这k个邻居的输出值的平均值,将其作为待预测样本点的预测值。

-

二、基于K近邻算法的分类器实现

1.基本步骤

KNN算法的简单性使其成为许多分类问题中的首选算法。在实际应用中,我们可以使用Python来实现基于KNN的分类器。具体有以下步骤:

1.导入库:首先,我们需要导入必要的库,包括numpy、pandas和scikit-learn。

2.数据准备:准备训练数据和测试数据,并进行必要的数据预处理,如特征缩放和特征选择。

3.模型训练:使用训练数据训练KNN分类器模型。在scikit-learn中,可以使用KNeighborsClassifier类来实现。

4.模型评估:使用测试数据对训练好的模型进行评估,并计算分类器的性能指标,如准确率、召回率和F1值。

5.参数调优:根据需要,可以通过交叉验证等方法来调优KNN模型的参数,如K值和距离度量方法。

2.问题引入

海伦一直使用在线约会网站寻找适合自己的约会对象。她曾交往过三种类型的人:

-

不喜欢的人

-

一般喜欢的人

-

非常喜欢的人

这些人包含以下三种特征

-

每年获得的飞行常客里程数

-

玩视频游戏所耗时间百分比

-

每周消费的冰淇淋公升数

该网站现在需要尽可能向海伦推荐她喜欢的人,需要我们设计一个分类器,根据用户的以上三种特征,识别出是否该向海伦推荐。

3.需求概要分析

根据问题,我们可知,样本特征个数为3,样本标签为三类。现需要实现将一个待分类样本的三个特征值输入程序后,能够识别该样本的类别,并且将该类别输出。

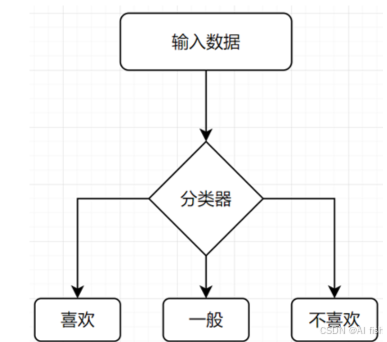

4.程序结构设计说明

根据问题,可以知道程序大致流程如下。

其中输入数据应包含三个值,输出应为喜欢,一般,不喜欢,三个中的一个。

5.K近邻算法的一般流程

-

数据准备:这包括收集、清洗和预处理数据。预处理可能包括归一化或标准化特征,以确保所有特征在计算距离时具有相等的权重。

| 玩视频游戏所耗时间百分比 | 每年获得的飞行常客里程数 | 每周消费的冰淇淋的公升数 | 样本分类 | |

|---|---|---|---|---|

| 1 | 0.8 | 400 | 0.5 | 1 |

| 2 | 12 | 134000 | 0.9 | 3 |

| 3 | 0 | 20000 | 1.1 | 2 |

| 4 | 67 | 32000 | 0.1 | 2 |

我们很容易发现,当计算样本之间的距离时数字差值最大的属性对计算结果的影响最大,也就是说,每年获取的飞行常客里程数对于计算结果的影响将远远大于上表中其他两个特征-玩视频游戏所耗时间占比和每周消费冰淇淋公斤数的影响。而产生这种现象的唯一原因,仅仅是因为飞行常客里程数远大于其他特征值。但海伦认为这三种特征是同等重要的,因此作为三个等权重的特征之一,飞行常客里程数并不应该如此严重地影响到计算结果。

在处理这种不同取值范围的特征值时,我们通常采用的方法是将数值归一化,如将取值范围处理为0到1或者-1到1之间。下面的公式可以将任意取值范围的特征值转化为0到1区间内的值:

-

选择距离度量方法:确定用于比较样本之间相似性的度量方法,常见的如欧几里得距离、曼哈顿距离等。

-

确定K值:选择一个K值,即在分类或回归时应考虑的邻居数量。这是一个超参数,可以通过交叉验证等方法来选择最优的K值。

-

找到K个最近邻居:对于每一个需要预测的未标记的样本:

-

计算该样本与训练集中所有样本的距离。

-

根据距离对它们进行排序。

-

选择距离最近的K个样本

-

预测:

-

对于分类任务:查看K个最近邻居中最常见的类别,作为预测结果。例如,如果K=3,并且三个最近邻居的类别是[1, 2, 1],那么预测结果就是类别1。

-

对于回归任务:预测结果可以是K个最近邻居的平均值或加权平均值。

-

-

评估:使用适当的评价指标(如准确率、均方误差等)评估模型的性能。

-

优化:基于性能评估结果,可能需要返回并调整某些参数,如K值、距离度量方法等,以获得更好的性能。

6.算法实现

1.相关库和依赖的安装

1.1numpy库的安装(两种方法)

使用 Anaconda 安装

如果你使用的是 Anaconda 环境,可以按照以下步骤安装 NumPy:

- 打开 Anaconda Prompt:在 Windows 系统中,可以在开始菜单里找到 Anaconda Prompt 并打开;在 macOS 或 Linux 系统中,打开终端。

- 创建并激活环境(可选):如果你想要在特定的环境中安装

NumPy,可以先创建一个新的环境并激活它。

# 创建一个名为 myenv 的新环境,指定 Python 版本为 3.9

conda create -n myenv python=3.9

# 激活环境

conda activate myenv

- 安装

NumPy:在激活的环境中运行以下命令来安装NumPy。

conda install numpy

- 验证安装:安装完成后,可以在 Python 解释器中验证

NumPy是否安装成功。

import numpy as np

print(np.__version__)

使用 pip 安装

如果你使用的是标准的 Python 环境,可以使用 pip 来安装 NumPy,具体步骤如下:

- 打开终端:在 Windows 系统中,打开命令提示符或 PowerShell;在 macOS 或 Linux 系统中,打开终端。

- 创建并激活虚拟环境(可选):为了避免不同项目之间的依赖冲突,建议使用虚拟环境。

# 创建一个名为 myenv 的虚拟环境

python -m venv myenv

# 激活虚拟环境

# 在 Windows 上

myenv\Scripts\activate

# 在 macOS 或 Linux 上

source myenv/bin/activate

- 安装

NumPy:在激活的虚拟环境中运行以下命令来安装NumPy。

pip install numpy

- 验证安装:安装完成后,可以在 Python 解释器中验证

NumPy是否安装成功。

import numpy as np

print(np.__version__)1.2matplotlib库的安装

利用Anconda安装

- 可以在开始菜单里找到 Anaconda Prompt 并打开;在 macOS 或 Linux 系统中,打开终端。

安装matplotlib:在激活的环境中运行以下命令来安装matplotlib。

conda install matplotlib

在执行此命令时,Anaconda 会自动处理 matplotlib 及其依赖项的安装。

4. 验证安装:安装完成后,可以在 Python 解释器中验证 matplotlib 是否安装成功。

import matplotlib.pyplot as plt

plt.plot([1, 2, 3, 4])

plt.ylabel('some numbers')

plt.show()

运行上述代码后,如果弹出一个包含简单折线图的窗口,就说明 matplotlib 安装成功。

使用 pip 安装

如果你使用的是标准的 Python 环境,可以使用 pip 来安装 matplotlib,具体步骤如下:

- 打开终端:在 Windows 系统中,打开命令提示符或 PowerShell;在 macOS 或 Linux 系统中,打开终端。

安装matplotlib:在激活的虚拟环境中运行以下命令来安装matplotlib。

pip install matplotlib

pip 会从 Python Package Index(PyPI)下载并安装 matplotlib 及其依赖项。

4. 验证安装:安装完成后,可以在 Python 解释器中验证 matplotlib 是否安装成功。使用与上述 Anaconda 验证步骤相同的代码进行验证。

2.利用numpy库处理数据

利用numpy库从文本文件中读取数据,并将其转换为用于机器学习的特征矩阵和对应的分类标签向量。

import numpy as np

def file2matrix(filename):

# 打开文件

fr = open(filename)

# 读取文件所有内容

arrayOLines = fr.readlines()

# 得到文件行数

numberOfLines = len(arrayOLines)

# 返回的NumPy矩阵,解析完成的数据:numberOfLines行,3列

returnMat = np.zeros((numberOfLines, 3))

# 返回的分类标签向量

classLabelVector = []

# 行的索引值

index = 0

for line in arrayOLines:

# s.strip(rm),当rm空时,默认删除空白符(包括'\n','\r','\t',' ')

line = line.strip()

# 使用s.split(str="",num=string,cout(str))将字符串根据'\t'分隔符进行切片。

listFromLine = line.split('\t')

# 将数据前三列提取出来,存放到returnMat的NumPy矩阵中,也就是特征矩阵

returnMat[index, :] = listFromLine[0:3]

# 根据文本中标记的喜欢的程度进行分类,1代表不喜欢,2代表魅力一般,3代表极具魅力

if listFromLine[-1] == 'didntLike':

classLabelVector.append(1)

elif listFromLine[-1] == 'smallDoses':

classLabelVector.append(2)

elif listFromLine[-1] == 'largeDoses':

classLabelVector.append(3)

index += 1

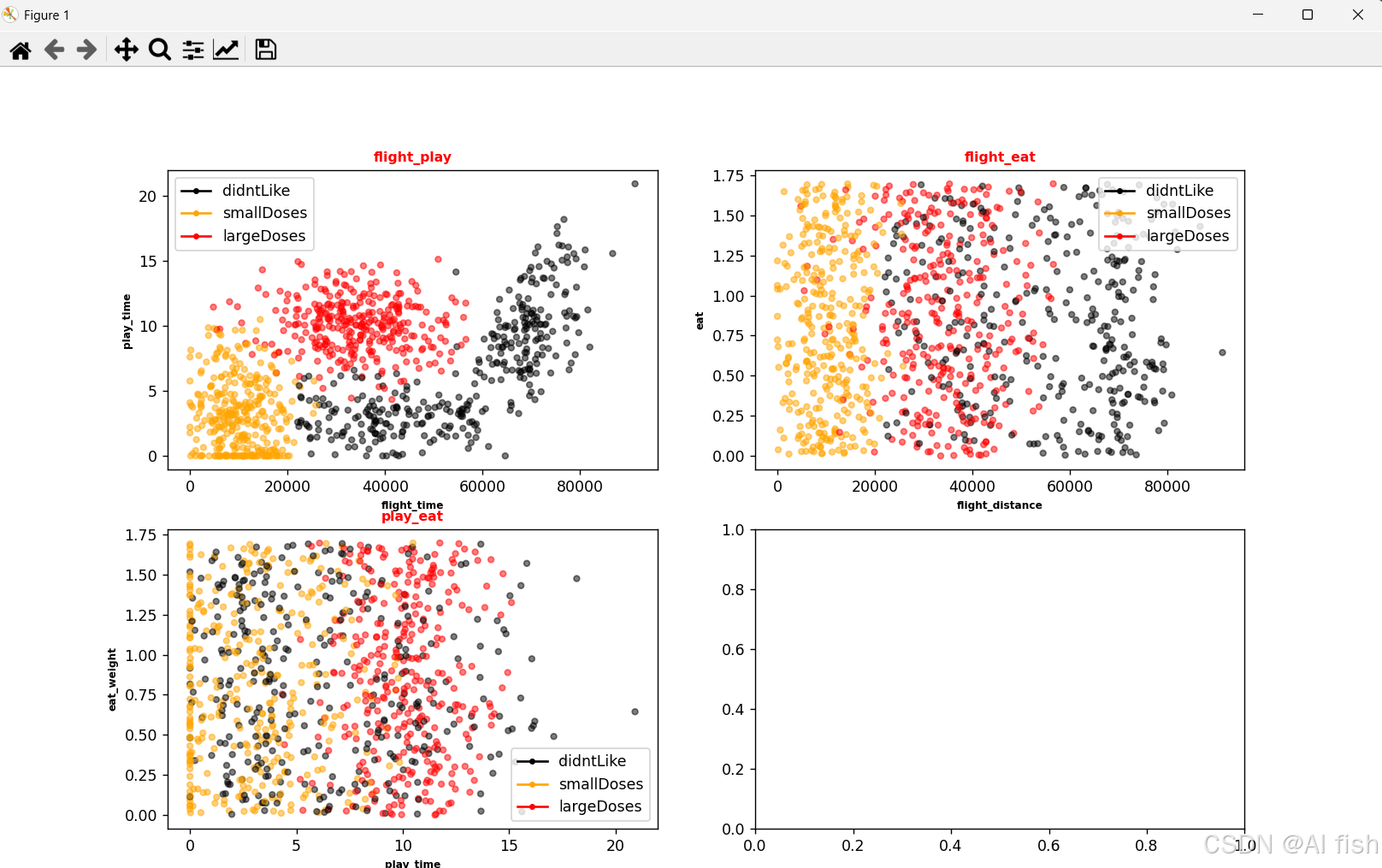

return returnMat, classLabelVector3.创建散点图

具体来说,它会根据不同的特征组合绘制散点图,并根据数据的分类标签为散点设置不同的颜色,同时添加图例来解释不同颜色所代表的分类。

import matplotlib.pyplot as plt

import matplotlib.lines as mlines

def showData(datingDataMat, datingLabels):

fig, axs = plt.subplots(nrows=2, ncols=2, sharex=False, sharey=False, figsize=(13, 8))

LabelsColors = []

for i in datingLabels:

if i == 1:

LabelsColors.append('black')

if i == 2:

LabelsColors.append('orange')

if i == 3:

LabelsColors.append('red')

axs[0][0].scatter(x=datingDataMat[:, 0], y=datingDataMat[:, 1], color=LabelsColors, s=15, alpha=.5)

axs0_title_text = axs[0][0].set_title('flight_play')

axs0_xlabel_text = axs[0][0].set_xlabel('flight_time')

axs0_ylabel_text = axs[0][0].set_ylabel('play_time')

plt.setp(axs0_title_text, size=9, weight='bold', color='red')

plt.setp(axs0_xlabel_text, size=7, weight='bold', color='black')

plt.setp(axs0_ylabel_text, size=7, weight='bold', color='black')

axs[0][1].scatter(x=datingDataMat[:, 0], y=datingDataMat[:, 2], color=LabelsColors, s=15, alpha=.5)

# 设置标题,x轴label,y轴label

axs1_title_text = axs[0][1].set_title('flight_eat')

axs1_xlabel_text = axs[0][1].set_xlabel('flight_distance')

axs1_ylabel_text = axs[0][1].set_ylabel('eat')

plt.setp(axs1_title_text, size=9, weight='bold', color='red')

plt.setp(axs1_xlabel_text, size=7, weight='bold', color='black')

plt.setp(axs1_ylabel_text, size=7, weight='bold', color='black')

# 画出散点图,以datingDataMat矩阵的第二(玩游戏)、第三列(冰激凌)数据画散点数据,散点大小为15,透明度为0.5

axs[1][0].scatter(x=datingDataMat[:, 1], y=datingDataMat[:, 2], color=LabelsColors, s=15, alpha=.5)

# 设置标题,x轴label,y轴label

axs2_title_text = axs[1][0].set_title('play_eat')

axs2_xlabel_text = axs[1][0].set_xlabel('play_time')

axs2_ylabel_text = axs[1][0].set_ylabel('eat_weight')

plt.setp(axs2_title_text, size=9, weight='bold', color='red')

plt.setp(axs2_xlabel_text, size=7, weight='bold', color='black')

plt.setp(axs2_ylabel_text, size=7, weight='bold', color='black')

# 设置图例

didntLike = mlines.Line2D([], [], color='black', marker='.',

markersize=6, label='didntLike')

smallDoses = mlines.Line2D([], [], color='orange', marker='.',

markersize=6, label='smallDoses')

largeDoses = mlines.Line2D([], [], color='red', marker='.',

markersize=6, label='largeDoses')

# 添加图例

axs[0][0].legend(handles=[didntLike, smallDoses, largeDoses])

axs[0][1].legend(handles=[didntLike, smallDoses, largeDoses])

axs[1][0].legend(handles=[didntLike, smallDoses, largeDoses])

# 显示图片

plt.show()4.归一化处理

归一化是数据预处理中的一个重要步骤,它可以将不同特征的数据缩放到相同的范围,避免某些特征因为数值范围过大而在机器学习算法中占据主导地位,从而提高模型的性能和收敛速度。

归一化公式:Xnorm=Xmax−XminX−Xmin

其中,X 是原始数据,Xmin 是数据的最小值,Xmax 是数据的最大值,Xnorm 是归一化后的数据。

def autoNorm(dataSet):

# 获得数据的最大值和最小值

minVals = dataSet.min(0)

maxVals = dataSet.max(0)

# 最大值和最小值的范围

ranges = maxVals - minVals

# shape(dataSet)返回dataSet的矩阵行列数

normDataSet = np.zeros(np.shape(dataSet))

# 返回dataSet的行数

m = dataSet.shape[0]

# 原始值减去最小值

normDataSet = dataSet - np.tile(minVals, (m, 1))

# 除以最大和最小值的差,得到归一化数据

normDataSet = normDataSet / np.tile(ranges, (m, 1))

# 返回归一化数据结果,数据范围,最小值

return normDataSet, ranges, minVals5.实现分类器函数

计算待分类向量与训练数据集中每个样本的距离,选择距离最近的 k 个样本,统计这 k 个样本中各个类别的出现次数,最后返回出现次数最多的类别作为待分类向量的分类结果。

def classify0(inX, dataSet, labels, k):

distances = np.sqrt(np.sum((dataSet - inX)**2, axis=1))

sortedIndices = distances.argsort()

classCount = {}

for i in range(k):

voteLabel = labels[sortedIndices[i]]

classCount[voteLabel] = classCount.get(voteLabel, 0) + 1

sortedClassCount = sorted(classCount.items(), key=lambda x: x[1], reverse=True)

return sortedClassCount[0][0]6.测试准确率

通过将数据集的前 10% 作为测试集,剩余 90% 作为训练集,使用 classify0 函数对测试集进行分类,并统计分类错误的样本数量,最后计算并打印分类的错误率,以此来评估 classify0 函数实现的 k - 近邻分类算法的性能。

def test_mistake(normDataSet, datingLabels):

m = normDataSet.shape[0]

numTestVecs = int(m * 0.1)

errorCount = 0.0

for i in range(numTestVecs):

classifyResult = classify0(normDataSet[i, :], normDataSet[numTestVecs:m, :],

datingLabels[numTestVecs:m], 4)

print("分类结果:%d,真实类别:%d" % (classifyResult, datingLabels[i]))

if classifyResult != datingLabels[i]:

errorCount += 1.0

print("错误率:%f%%" % (errorCount / float(numTestVecs) * 100))7.进行分类

输入特征,得出结果

def classifyPerson():

# 输出结果

resultList = ['讨厌', '有些喜欢', '非常喜欢']

# 三维特征用户输入

ffMiles = float(input("每年获得的飞行常客里程数:"))

precentTats = float(input("玩视频游戏所耗时间百分比:"))

iceCream = float(input("每周消费的冰激淋公升数:"))

# 打开的文件名

filename = "datingTestSet.txt"

# 打开并处理数据

datingDataMat, datingLabels = file2matrix(filename)

# 训练集归一化

normMat, ranges, minVals = autoNorm(datingDataMat)

# 生成NumPy数组,测试集

# inArr = np.array([precentTats, ffMiles, iceCream])

inArr = np.array([ffMiles, precentTats, iceCream])

# 测试集归一化

norminArr = (inArr - minVals) / ranges

# 返回分类结果

classifierResult = classify0(norminArr, normMat, datingLabels, 3)

# 打印结果

print("你可能%s这个人" % (resultList[classifierResult - 1]))8.main函数与测试函数

def main():

filename = "datingTestSet.txt"

datingDataMat, datingLabels = file2matrix(filename)

showData(datingDataMat, datingLabels)

test_mistake(datingDataMat, datingLabels)

classifyPerson() # 用户输入特征并获取预测结果

if __name__ == '__main__':

main()总结

K近邻算法是一种简单而有效的分类算法,它通过测量样本之间的距离来对新样本进行分类。基于KNN算法的分类器在实际应用中具有广泛的应用,可以用于图像分类、文本分类、推荐系统等领域。通过学习和实践,我们可以更好地理解KNN算法的原理和实现,并将其应用于实际问题中。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)