安装 Dify 并集成 Ollama 和 Xinference

Dify是一款开源的大语言模型(LLM)应用开发平台,旨在帮助开发者快速构建和部署生成式 AI 应用。融合 Backend as Service 和 LLMOps 理念:Dify 将后端即服务(Backend as Service)和 LLMOps 的理念结合,使开发者能够快速搭建生产级的生成式 AI 应用。支持多种模型:Dify 支持数百种专有和开源的 LLM 模型,包括 GPT、Mistral

本文介绍了通过 Docker 安装 Dify,然后集成 Ollama 和 XInference,并利用 Dify 快速搭建一个基于知识库问答的应用。

-

一、Dify 简介

-

二、Dify 安装

-

三、Dify 添加Ollama模型问答

-

四、Dify 基于知识库问答

-

五、文档链接

一、Dify 简介

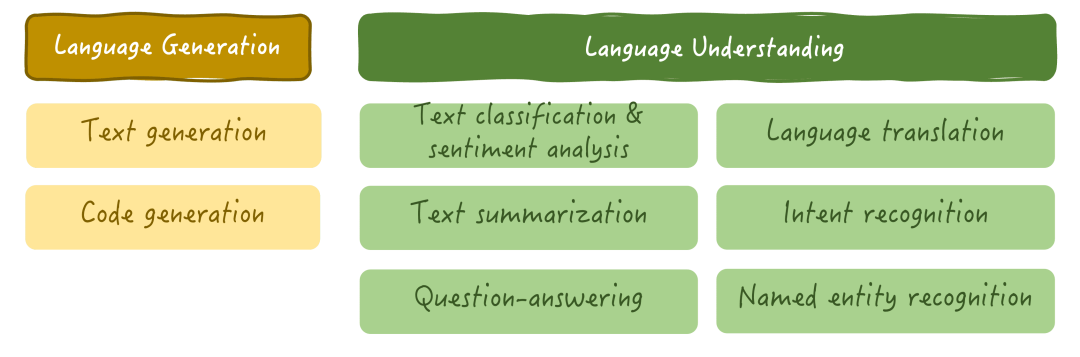

Dify 是一款开源的大语言模型(LLM)应用开发平台,旨在帮助开发者快速构建和部署生成式 AI 应用。以下是 Dify 的主要功能和特点 [1]:

-

融合 Backend as Service 和 LLMOps 理念:Dify 将后端即服务(Backend as Service)和 LLMOps 的理念结合,使开发者能够快速搭建生产级的生成式 AI 应用。

-

支持多种模型:Dify 支持数百种专有和开源的 LLM 模型,包括 GPT、Mistral、Llama3 等,能够无缝集成来自多家推理提供商和自托管解决方案的模型。

-

直观的 Prompt 编排界面:Dify 提供了一个直观的 Prompt IDE,用于编写提示、比较模型性能,并向基于聊天的应用程序添加语音转换等附加功能。

-

高质量的 RAG 引擎:Dify 拥有广泛的 RAG 功能,涵盖从文档摄取到检索的一切,并支持从 PDF、PPT 等常见文档格式中提取文本。

-

集成 Agent 框架:用户可以基于 LLM 函数调用或 ReAct 定义代理,并为代理添加预构建或自定义工具。Dify 提供了 50 多种内置工具,如 Google 搜索、DELL·E、Stable Diffusion 和 WolframAlpha。

-

灵活的流程编排:Dify 提供了一个强大的可视化画布,用于构建和测试强大的 AI 工作流,使开发者可以直观地设计和优化他们的 AI 流程。

-

全面的监控和分析工具:Dify 提供了监控和分析应用日志和性能的工具,开发者可以根据生产数据和注释不断改进提示、数据集和模型。

-

后端即服务:Dify 的所有功能都附带相应的 API,因此可以轻松将 Dify 集成到您自己的业务逻辑中。

二、Dify 安装

拷贝 Dify Github代码到本地 [2]。

git clone https://github.com/langgenius/dify.git

进入 dify 源代码的 docker 目录,拷贝环境变量。

cd dify/docker

cp .env.example .env

通过docker compose安装应用。

docker compose up -d

进入ollama容器,启动qwen2:7b模型。

root@ip-172-31-30-167:~/dify/docker# docker pull ollama/ollama

root@ip-172-31-83-158:~/dify/docker# docker run -d --gpus=all -v ollama:/root/.ollama -p 11434:11434 --name ollama --restart always -e OLLAMA_KEEP_ALIVE=-1 ollama/ollama

root@ip-172-31-83-158:~/dify/docker# docker exec -it ollama bash

root@b094349fc98c:/# ollama run qwen2:7b

三、Dify 添加Ollama模型问答

通过EC2的公网IP地址加上80端口,登录Dify主页,创建管理账户。

通过管理员账号登录。

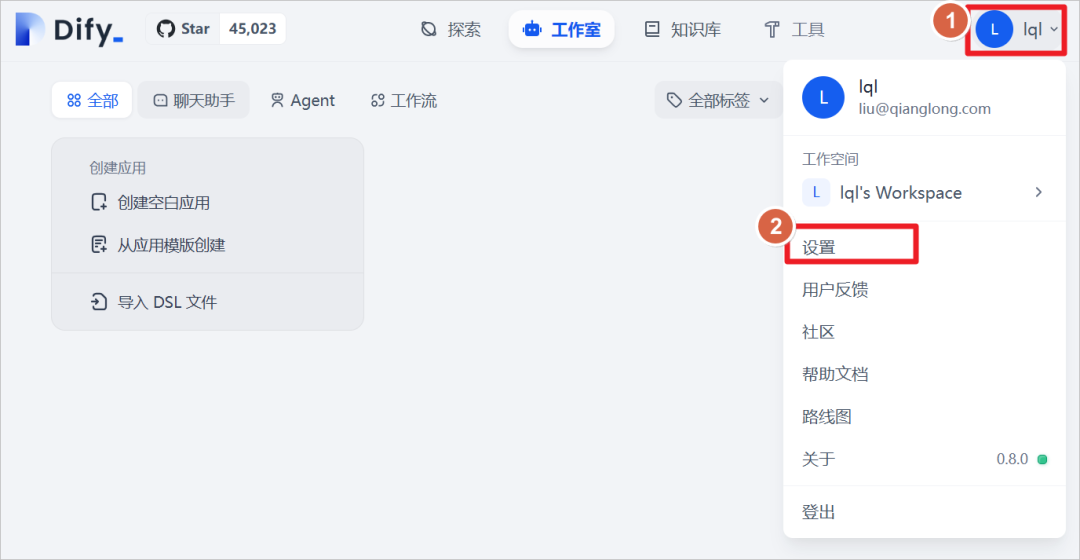

点击用户-设置。

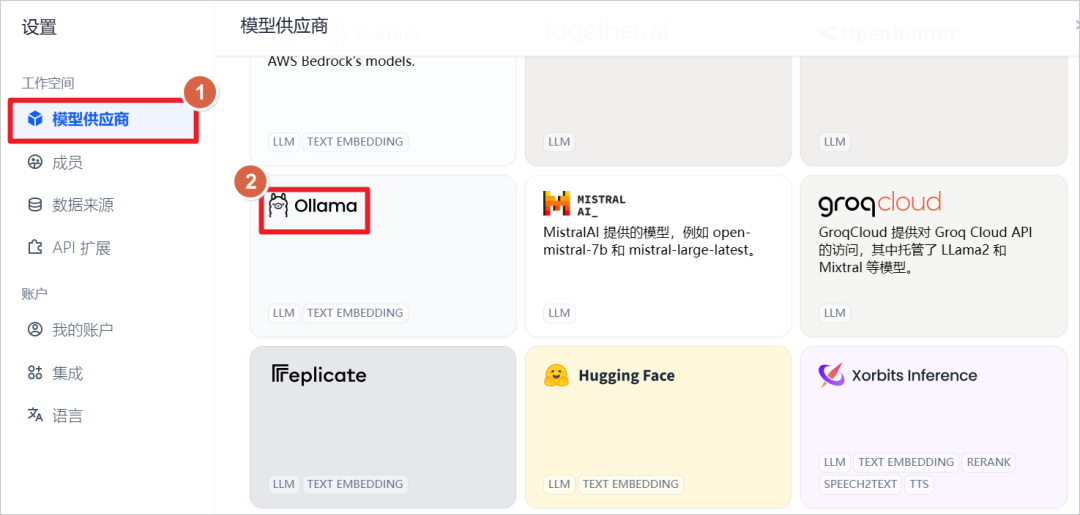

添加Ollama模型。

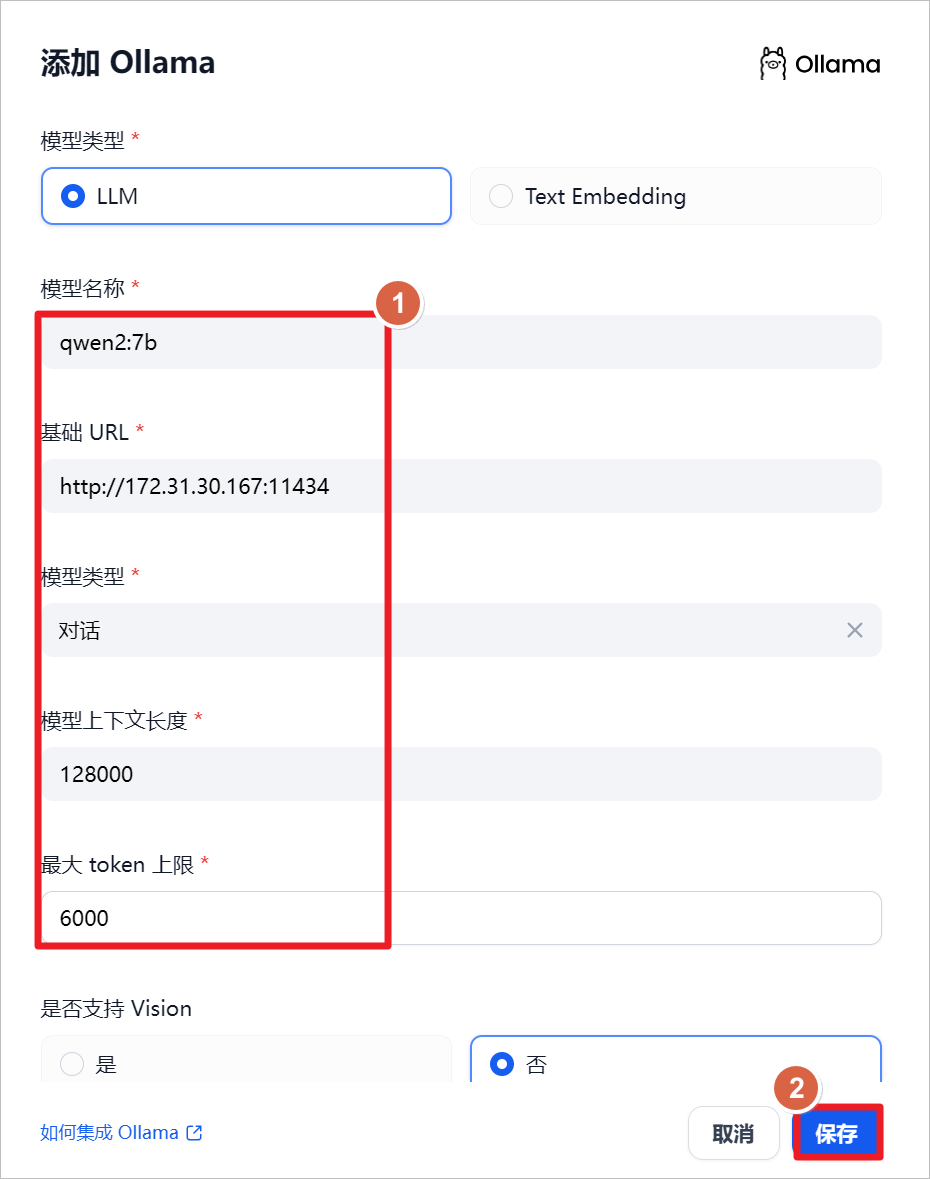

添加qwen2:7b模型,因为Ollama是在本机启动,所以设置URL为本地IP地址,端口为114341,

“

qwen2-7b-instruct 利用YARN(一种增强模型长度外推的技术)支持 131,072 tokens上下文,为了保障正常使用和正常输出,建议API限定用户输入为 128,000 ,输出最大 6,144。[3]

”

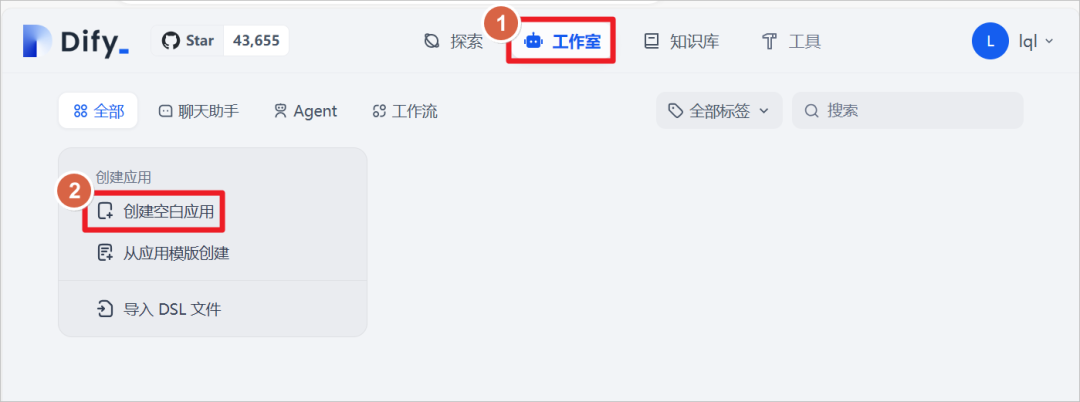

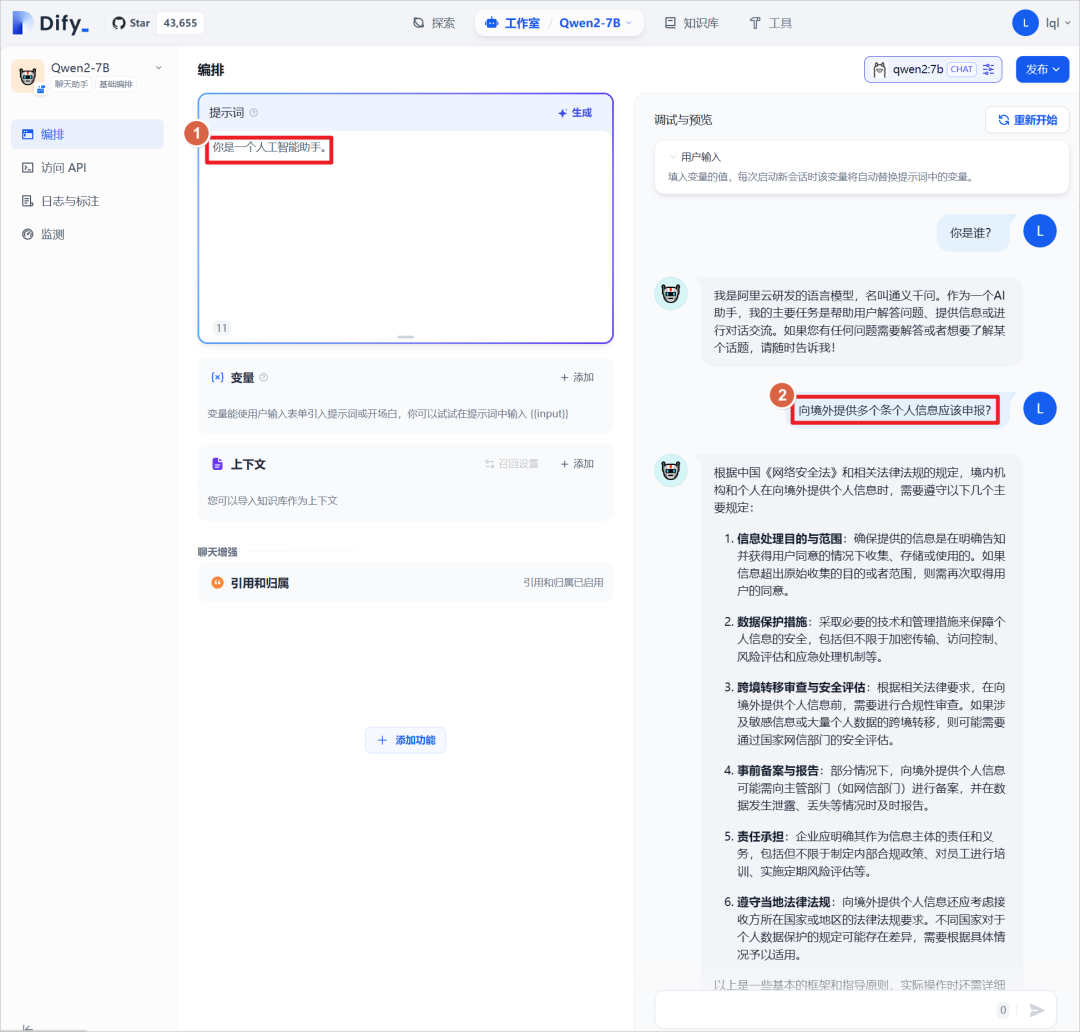

点击 工作室-创建空白应用

创建“聊天助手”类型的应用,设置应用名称为Qwen2-7B,点击创建。

为应用设置提示词"你是一个人工智能助手",可以和Qwen2:7B进行对话测试,这里是和大模型本身进行对话,没有引入外部的知识库,后续会引入知识库比较回答的结果。

👉[CSDN大礼包🎁:全网最全《LLM大模型入门+进阶学习资源包》免费分享(安全链接,放心点击)]()👈

四、Dify 基于知识库问答

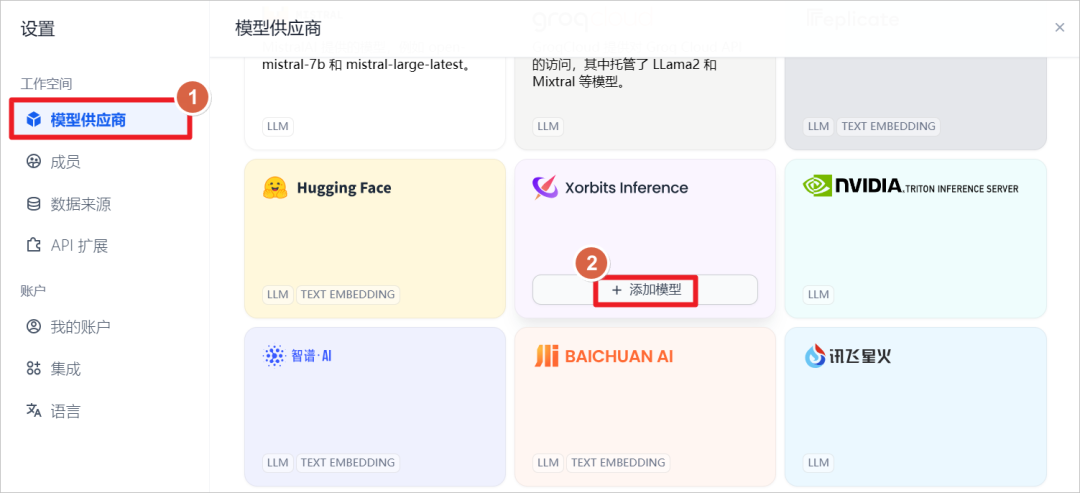

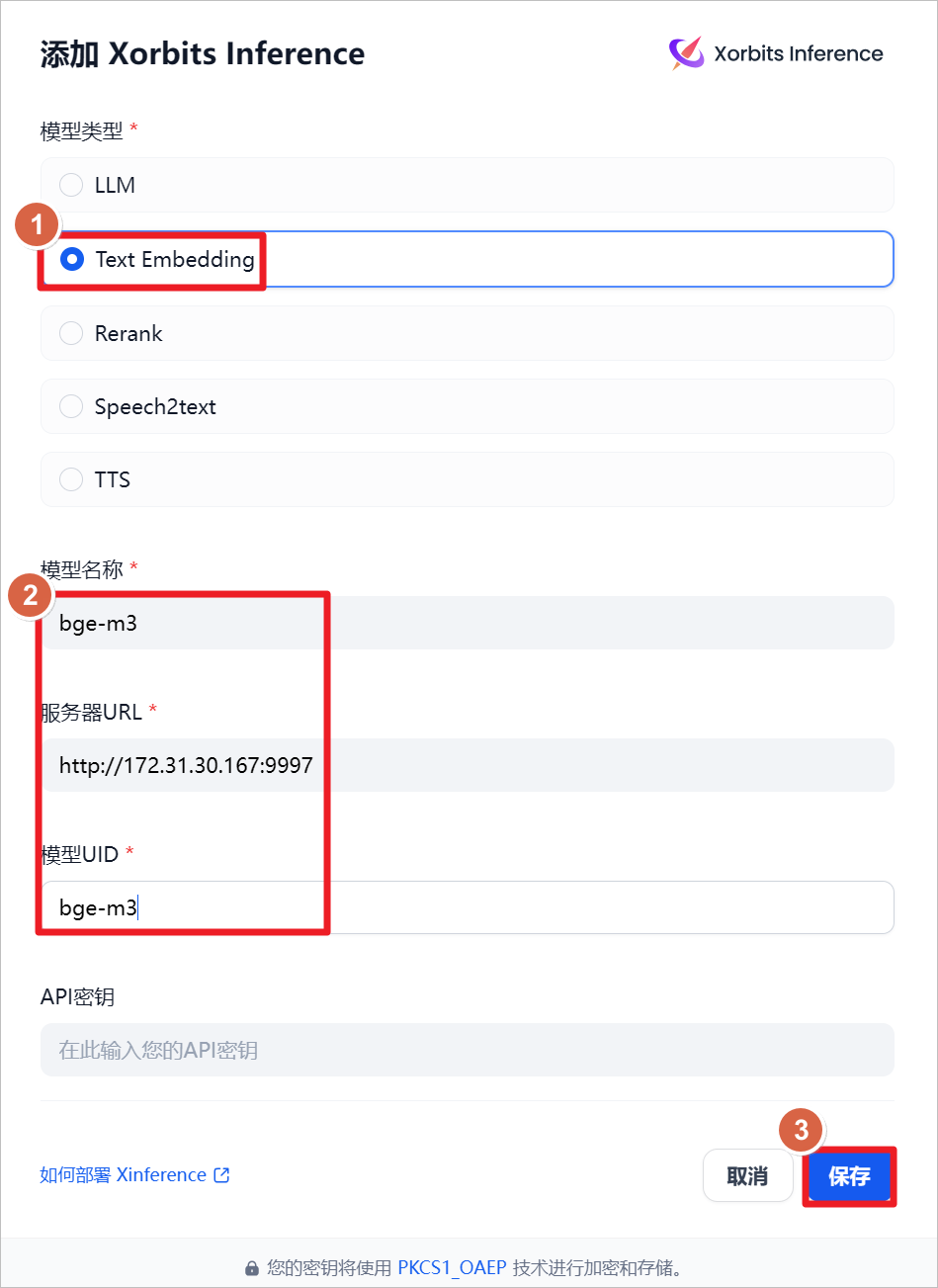

添加Xorbits Inference提供的模型。

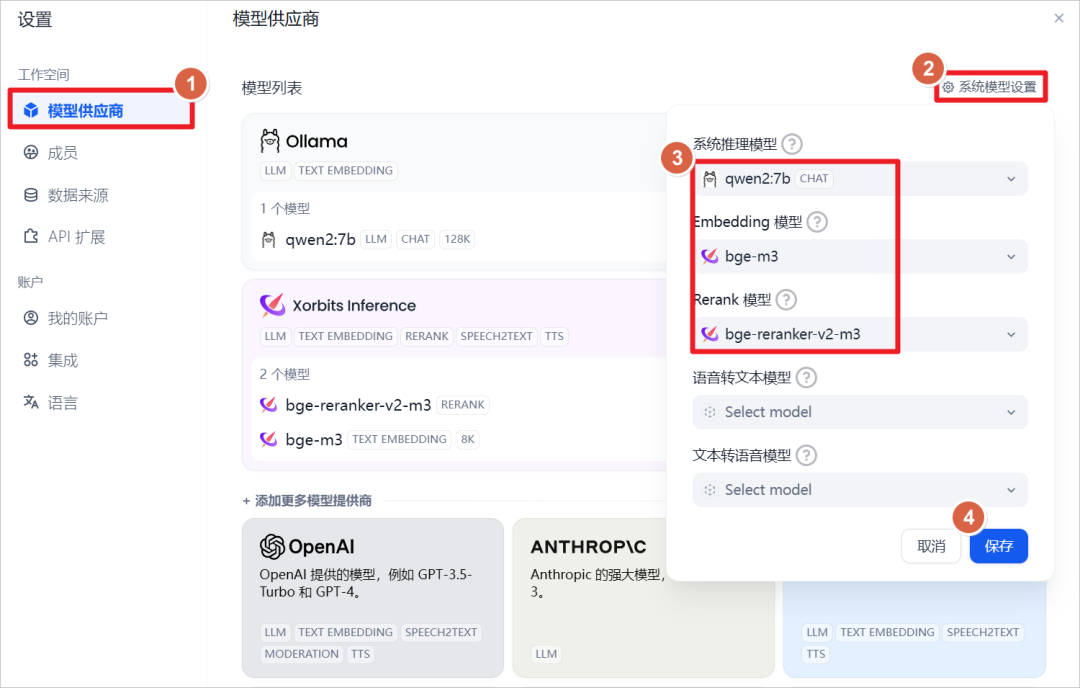

添加Text Embedding,即文本嵌入模型,模型的名称为bge-m3,服务器URL为http://172.31.30.167:9997(这里是本机的IP,也可以安装在其他机器,网络和端口可达即可),已经提前在本机上启动了XInference,并且启动了bge-m3模型(参考上一篇文章)。

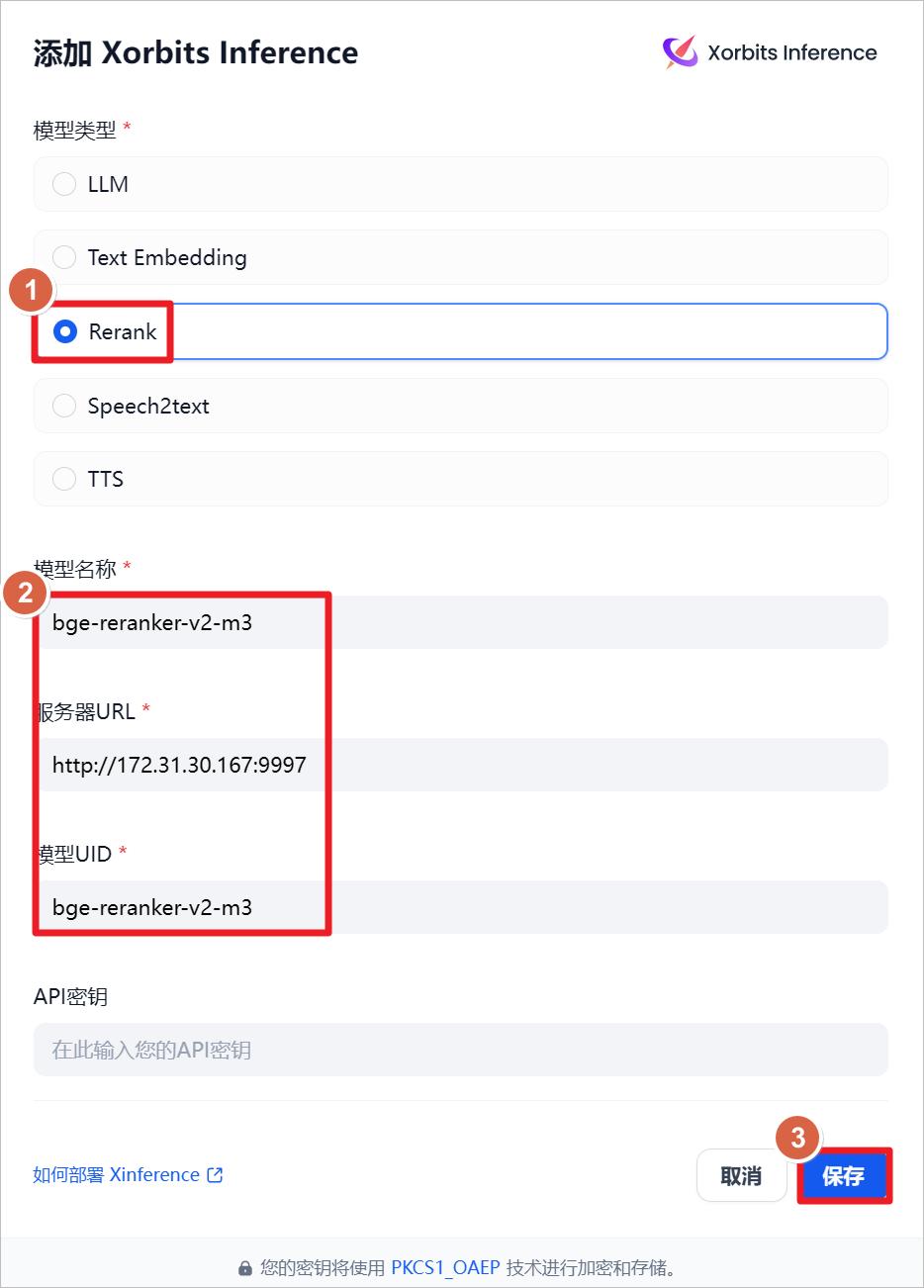

添加Rerank,即重排模型,模型的名称为bge-reraker-v2-m3,服务器URL为http://172.31.30.167:9997(这里是本机的IP,也可以安装在其他机器,网络和端口可达即可),已经提前在本机上启动了XInference,并且启动了bge-reraker-v2-m3模型(参考上一篇文章)。

查看系统默认设置。

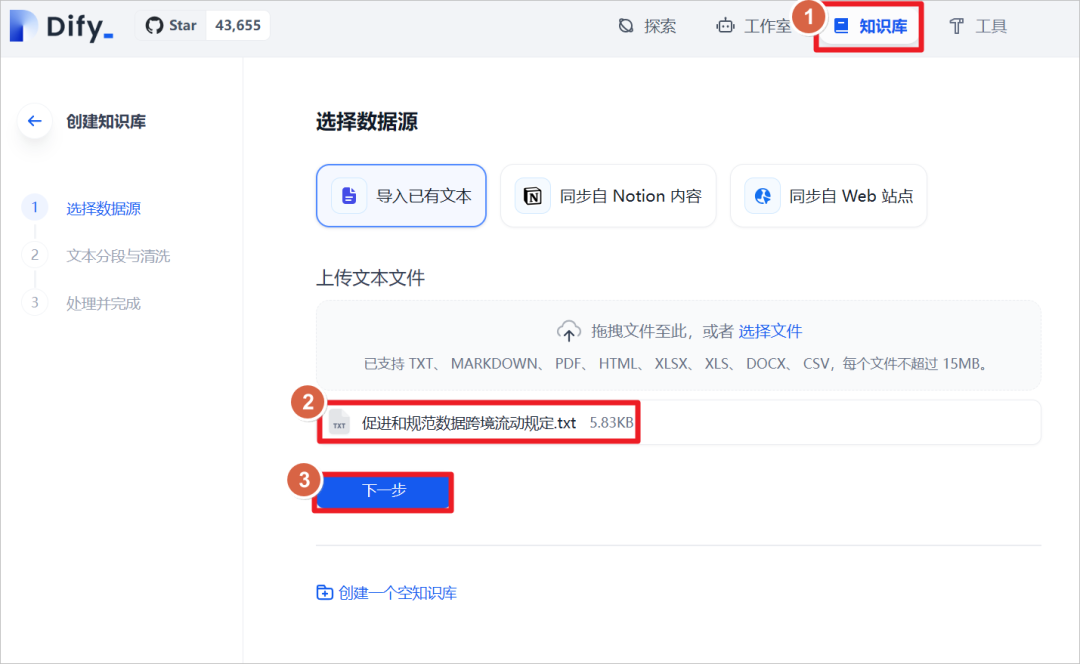

点击“知识库”-“导入已有文本”-“上传文本文件”-选择《促进和规范数据跨境流动规定》的文档。

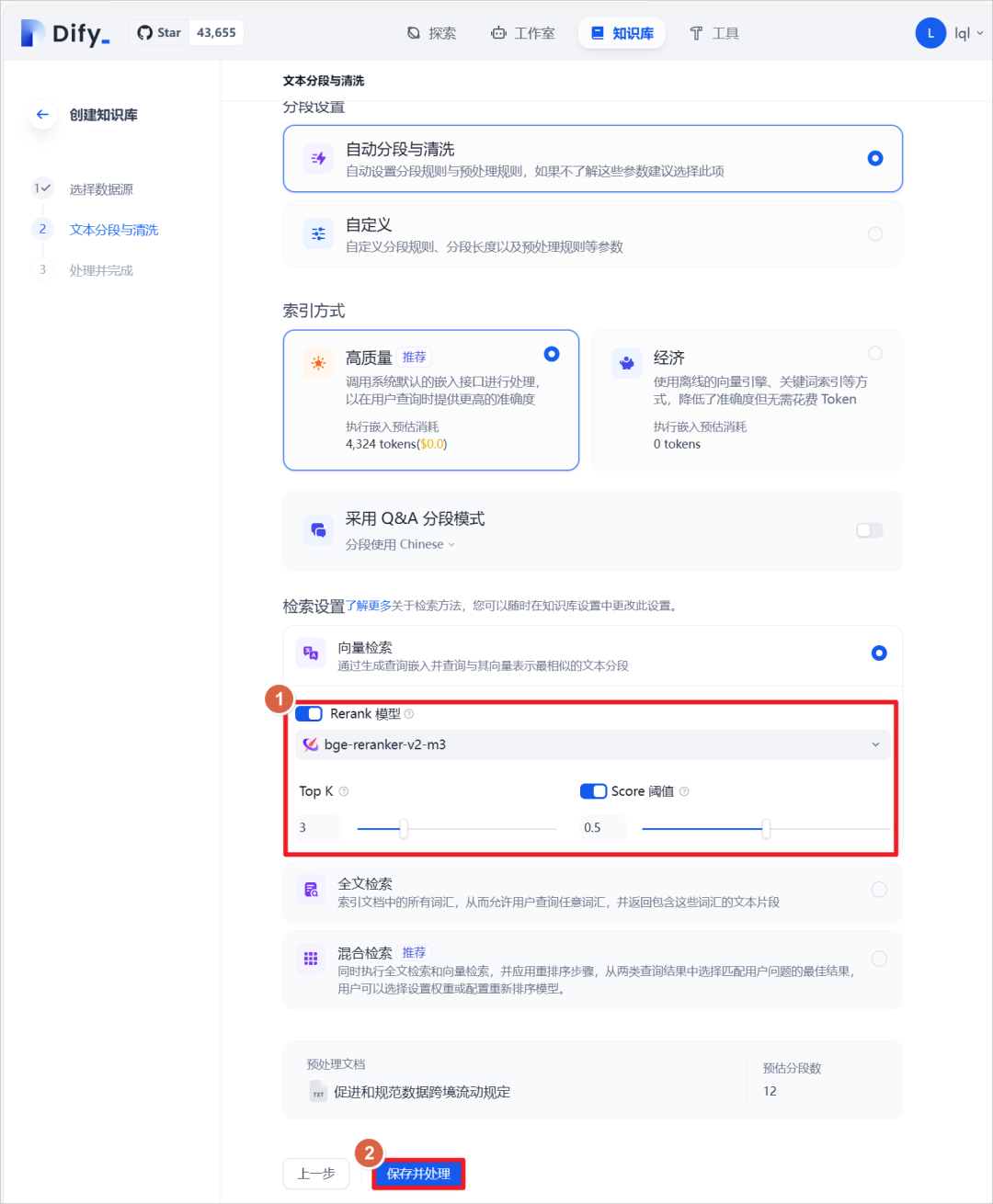

导入成功后,设置文本检索方式,开启Rerank模型,选择bge-reranker-v2-m3模型,开启默认的Score阈值为0.5(即文本匹配度低于0.5分时,不会召回,不会添加到大模型的上下文中)。

在之前的聊天应用中,添加上面创建的知识库,重新询问大模型相同的问题,可以看到模型结合知识库进行了回答。

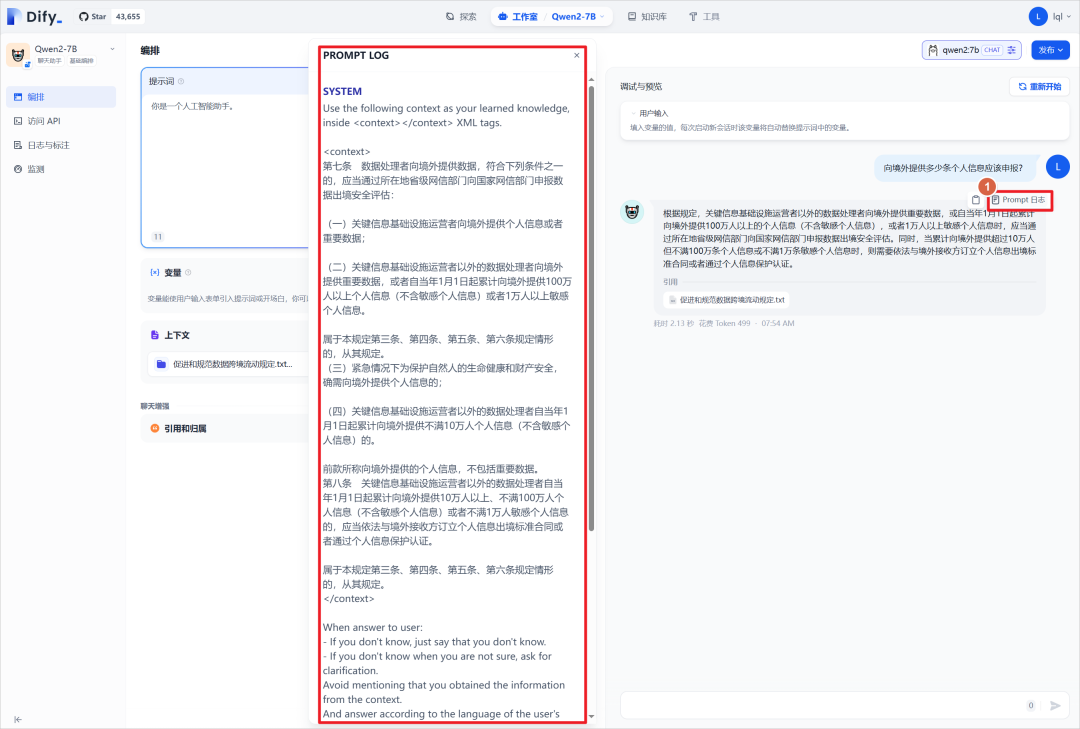

可以点击“Prompt日志”,查看日志文件,可以查看系统提示词,将匹配的知识库内容放在了<context></context>中。

点击创建的知识库-点击“召回测试”,可以输入一段文本,用与匹配知识库中的文本,匹配到的文本有一个权重分数,上面设置过的阈值是0.5,即大于这个分数的才会显示为“召回段落”。

五、文档链接

-

[1] Dify 官网:https://dify.ai/zh

-

[2] Dify Docker Compose 部署:https://docs.dify.ai/v/zh-hans/getting-started/install-self-hosted/docker-compose

-

[3] Qwen Token限制:https://help.aliyun.com/zh/dashscope/developer-reference/tongyi-qianwen-7b-14b-72b-api-detailes

在大模型时代,我们如何有效的去学习大模型?

现如今大模型岗位需求越来越大,但是相关岗位人才难求,薪资持续走高,AI运营薪资平均值约18457元,AI工程师薪资平均值约37336元,大模型算法薪资平均值约39607元。

掌握大模型技术你还能拥有更多可能性:

• 成为一名全栈大模型工程师,包括Prompt,LangChain,LoRA等技术开发、运营、产品等方向全栈工程;

• 能够拥有模型二次训练和微调能力,带领大家完成智能对话、文生图等热门应用;

• 薪资上浮10%-20%,覆盖更多高薪岗位,这是一个高需求、高待遇的热门方向和领域;

• 更优质的项目可以为未来创新创业提供基石。

可能大家都想学习AI大模型技术,也_想通过这项技能真正达到升职加薪,就业或是副业的目的,但是不知道该如何开始学习,因为网上的资料太多太杂乱了,如果不能系统的学习就相当于是白学。为了让大家少走弯路,少碰壁,这里我直接把都打包整理好,希望能够真正帮助到大家_。

👉[CSDN大礼包🎁:全网最全《LLM大模型入门+进阶学习资源包》免费分享(安全链接,放心点击)]()👈

一、AGI大模型系统学习路线

很多人学习大模型的时候没有方向,东学一点西学一点,像只无头苍蝇乱撞,下面是我整理好的一套完整的学习路线,希望能够帮助到你们学习AI大模型。

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、AI大模型经典PDF书籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型各大场景实战案例

结语

【一一AGI大模型学习 所有资源获取处(无偿领取)一一】

所有资料 ⚡️ ,朋友们如果有需要全套 《LLM大模型入门+进阶学习资源包》,扫码获取~

👉[CSDN大礼包🎁:全网最全《LLM大模型入门+进阶学习资源包》免费分享(安全链接,放心点击)]()👈

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)