Assembly101:用于理解程序活动的大规模多视图视频数据集

22年3月来自Meta和新加坡国立的论文“Assembly101: A Large-Scale Multi-View Video Dataset for Understanding Procedural Activities”。

22年3月来自Meta和新加坡国立的论文“Assembly101: A Large-Scale Multi-View Video Dataset for Understanding Procedural Activities”。

Assembly101 是一个新的程序性活动数据集,包含 4321 个视频,记录了人们组装和拆卸 101 辆“可拆卸”玩具车的过程。参与者的工作没有固定的指示,序列在动作顺序、错误和更正方面具有丰富而自然的多变。Assembly101 是第一个多视图动作数据集,同时具有静态(8)和自我中心(4)记录。序列注释超过 100K 个粗粒度动作片段和 1M 个细粒度动作片段以及 18M 个 3D 手势。

对三个动作理解任务进行基准测试:识别、预估和时间分割。此外,提出一项检测错误的新任务。独特的记录格式和丰富的注释集能够研究对新玩具、跨视图迁移、长尾分布以及姿势与外观的泛化。

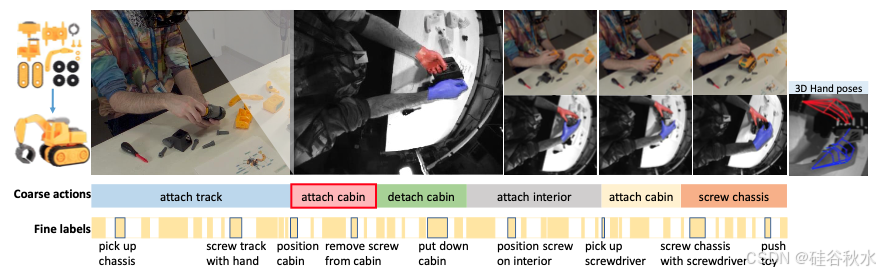

如图所示:Assembly101 包括同步静态多视角和自我中心记录,记录参与者组装和拆卸可拆解玩具的过程。序列标注了细粒度和粗粒度动作、3D 手势、参与者的技能水平以及粗粒度片段上的错误(例如,用红色突出显示的“安装机舱”)。

在多步活动方面的数据集

多步活动在烹饪和教学视频中表现得最为明显,因此该领域的大多数数据集都来自在线视频平台,例如 YouTube Instructional [1]、What’s Cooking [27]、YoucookII [50]、CrossTask [52]、COIN [49] 和 HowTo100M [29]。使用 YouTube 视频很有吸引力,因为数量庞大且种类繁多。然而,这些视频通常不适合 AR 设置,因为它们具有“制作”性质,例如混合视角、快进、不相关的叙述等。此外,这些数据集中的大多数来自厨房领域,主要用于研究视觉和自然语言中的多模态学习 [27, 50, 52]。

记录的数据集,例如 Breakfast [22]、GTEA [12]、50Salads [47] 是多步活动研究的主要贡献者 [9,10,39]。然而,它们要么很小[12,47],要么排序变化很小[22]。组装任务是一些数据集中探索的一个新领域[2,34],但它们的规模有限,对于深度学习来说不太理想。

自我中心和多视角的数据集

自我中心数据为人类活动提供了独特的视角,对于可穿戴设备(例如 AR 眼镜)尤其重要。小规模数据集包括 [12、20、32、34]。大规模数据集包括 EPIC-KITCHENS [5、6] 和最近的 Ego4D [17],后者的范围从厨房扩展到各种日常活动。与这些数据集相比,Assembly101 同时具有自我中心和第三人称视角,提供从外到内的同步特别信息以及用于 3D 动作识别的多视角自我中心数据。

多视角固定摄像机的数据集包括 IKEA [2] 和 Breakfast [22]。Assembly101采用同步的自我中心视图流,可以研究固定视图和自我中心视图之间的域差距。此外,相对于固定视图跟踪自我中心头部姿势,从而实现视点之间的几何推理。尽管 Charades-EGO [42] 也有人们执行脚本活动同时拍摄自我中心和第三人称视角,但这些视角是异步的,即独立记录实例。

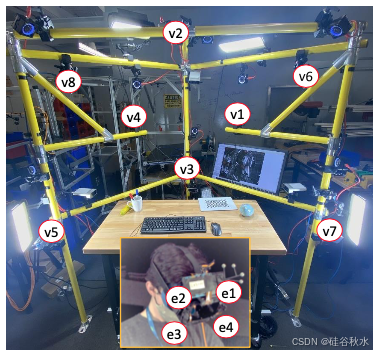

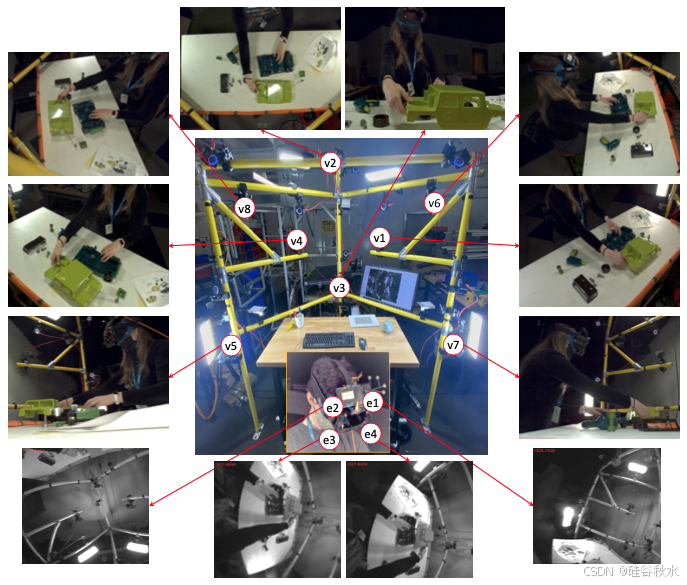

构建了一个桌面装置,配备了八个分辨率为 1920 × 1080 的 RGB 摄像头和四个分辨率为 640 × 480 的单色摄像头。RGB 摄像头安装在桌子周围的支架上,其中 5 个安装在上方,3 个安装在侧面。单色摄像头安装在参与者佩戴的定制耳机的四个角上,提供与 Oculus Quest VR 耳机类似多个以自我为中心的视图。如图所示是Assembly101采用定制的耳机(插图)和多摄像头桌面装置,摄像头用红色圆圈标记。

参与者:招募了 53 名成年人(28 名男性,25 名女性)来拆卸和组装“可拆卸”玩具车。每位参与者被要求在一小时的录制过程中使用六个玩具,但最终数量取决于参与者的速度。

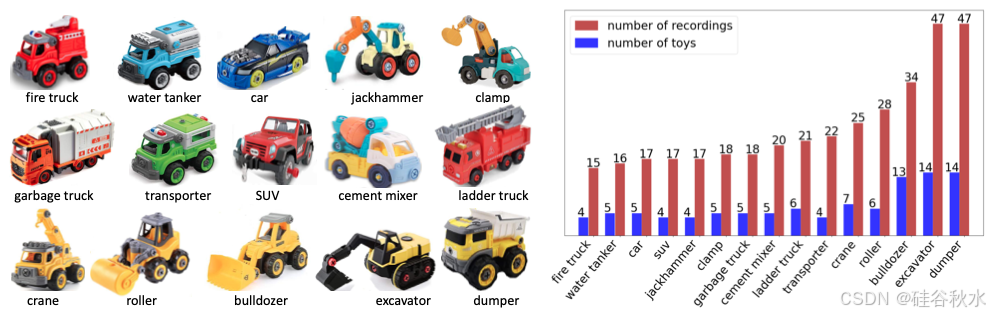

玩具:这些序列包含来自 15 个类别的 101 个独特玩具,包括建筑、应急响应和其他车辆。每个类别的车辆颜色、大小和样式各不相同;不同类别的车辆有一些共同的组件,例如建筑车辆具有相同的底座,但臂附件不同。如图显示了每个车辆类别的样本以及每个类别的玩具和记录分布。

协议:有兴趣捕捉参与者组装和拆卸玩具的自然顺序,因此只在桌子上放置了一张完全组装好的玩具图像以供参考。没有提供指令,也没有指定零件顺序。这种设计选择使组装任务更具挑战性,但也更加真实,从而导致动作顺序的巨大变化。初步记录显示,一些参与者在组装任务中遇到了困难。为了节省时间,调整了协议,让参与者先拆开一个完整的玩具,然后再“重新”组装。

如图是记录示例:

更多推荐

已为社区贡献158条内容

已为社区贡献158条内容

所有评论(0)